Wat is Seq2Seq?

Een AI-architectuur die een reeks invoer (bv. een zin in het Engels) omzet naar een reeks uitvoer (bv. diezelfde zin in het Frans) — de basis voor vertaalmachines en chatbots.

Wat is Seq2Seq eigenlijk?

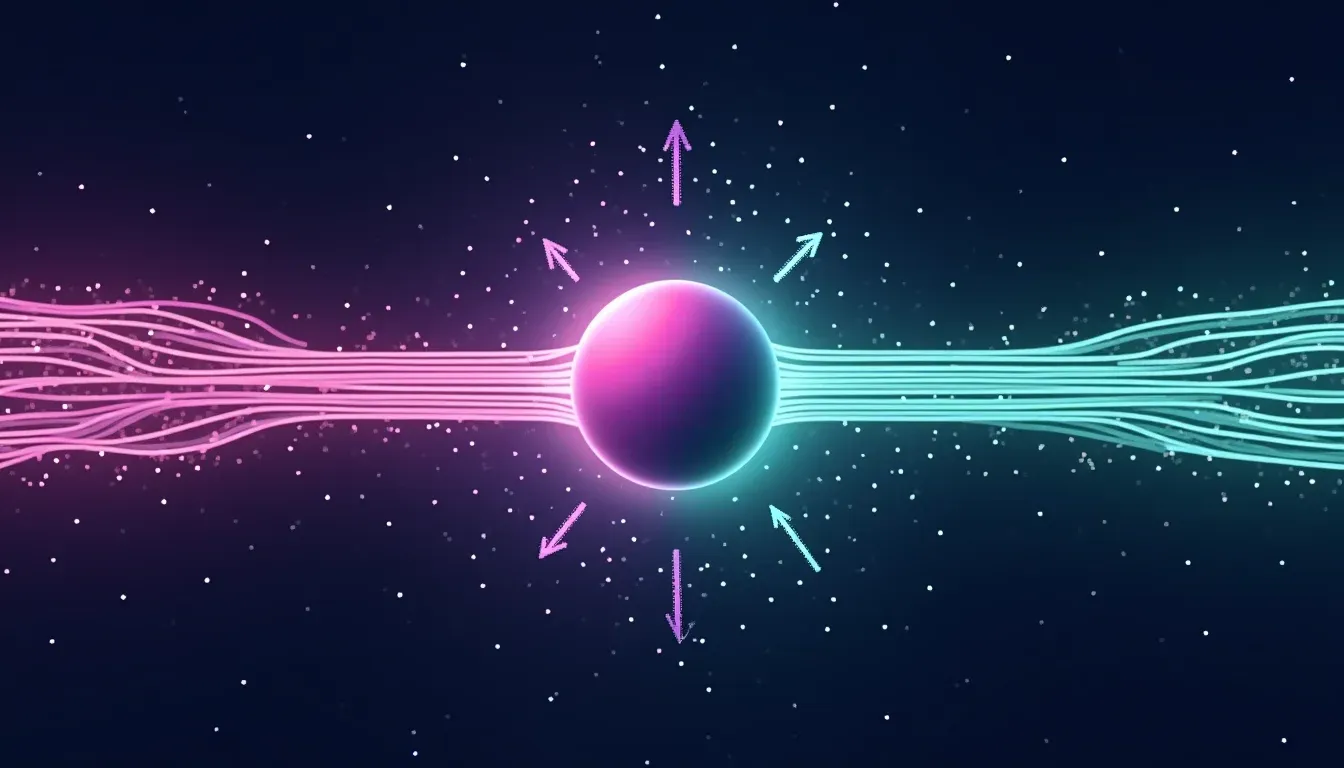

Seq2Seq (kort voor sequence-to-sequence) is een AI-architectuur die een reeks van informatie — bijvoorbeeld woorden in een zin — leest en vervolgens een nieuwe reeks produceert. Stel je voor dat je een recept in het Engels leest en het vervolgens in het Nederlands navertelt: je neemt de volgorde van stappen in, verwerkt ze, en zet ze om in een nieuwe volgorde woorden. Precies dat doet Seq2Seq: het leest de invoer van links naar rechts, comprimeert de betekenis in een soort 'gedachte', en rolt daar een nieuwe reeks uitvoer uit.

Deze architectuur bestaat uit twee delen: een encoder en een decoder. De encoder leest de invoer woord voor woord en bouwt een interne representatie op — een soort samenvatting van wat er gezegd is. De decoder neemt die samenvatting en produceert daar woord voor woord de uitvoer uit. Denk aan een tolk: die luistert naar een hele zin (encoder), begrijpt de kern, en spreekt vervolgens de vertaling uit (decoder).

Hoe werkt het in de praktijk?

Origineel kwam Seq2Seq uit onderzoek van Google in 2014, specifiek voor machinevertaling. Voor die tijd werkten vertalers met woordenboeken en vaste regels — Seq2Seq leerde in plaats daarvan patronen uit miljoenen vertaalde zinnen. Het model zag bijvoorbeeld duizenden keren hoe 'How are you?' werd vertaald naar 'Comment allez-vous?', en leerde zo de structuur van beide talen zonder expliciete grammaticaregels.

De architectuur is over het algemeen gebouwd met recurrente neurale netwerken (RNNs) of LSTM's — types netwerken die goed zijn in het onthouden van eerdere informatie terwijl ze door een reeks lopen. Later werden Seq2Seq-modellen vervangen door efficiëntere architecturen zoals Transformers (die tegenwoordig de basis vormen van ChatGPT en vergelijkbare tools), maar het principe blijft hetzelfde: invoer omzetten naar uitvoer, stap voor stap.

Waar kom je het tegen?

Je gebruikt Seq2Seq-technologie vaker dan je denkt:

Vertalers: Google Translate, DeepL en andere vertaaldiensten gebruikten Seq2Seq in eerdere versies (nu vaak Transformers, maar het idee is hetzelfde)

Chatbots en klantenservice-bots: een vraag wordt gelezen (encoder), de betekenis begrepen, en een antwoord geformuleerd (decoder)

Samenvattingen genereren: een lang artikel invoeren en er een korte samenvatting uit laten rollen

Spraakherkenning: gesproken woorden (audio-reeks) omzetten naar geschreven tekst (tekst-reeks)

Ondertiteling: automatisch ondertitels genereren bij video's

In veel moderne tools is Seq2Seq ondertussen vervangen door Transformer-modellen (die parallel werken in plaats van stap-voor-stap), maar het basisidee — invoer lezen, begrijpen, nieuwe uitvoer produceren — is overgebleven.

Een voorbeeld uit de praktijk

Stel: je runt een webshop en krijgt klantmails in verschillende talen. Een Seq2Seq-model kan die mails lezen, de vraag begrijpen, en een passend antwoord genereren — of in elk geval de mail vertalen naar jouw taal zodat je team ermee aan de slag kan. Of: je hebt klantenservice-logs en wilt daar automatisch een kort rapport van maken. De encoder leest alle logs, de decoder produceert een overzichtelijke samenvatting.

Waarom zou jij hier iets aan hebben?

Zelfs als je niet zelf Seq2Seq-modellen bouwt, helpt het om te begrijpen hoe AI van invoer naar uitvoer komt — vooral als je tools gebruikt die tekst genereren, vertalen of samenvatten. Je weet dan dat het model niet 'begrijpt' zoals een mens, maar patronen herkent tussen wat erin gaat en wat eruit moet komen. Dat maakt je verwachtingen realistischer: een Seq2Seq-model kan prachtig vertalen, maarSnapChat-slang of hele nieuwe woordspelingen kunnen lastig blijven, omdat het geen echte taalkennis heeft — alleen patronen uit data.

Wil je experimenteren met tekst-naar-tekst-toepassingen (vertaling, samenvatting, antwoordgeneratie), dan loop je vroeg of laat tegen Seq2Seq-principes aan — of de modernere variant, Transformers, die hetzelfde doel hebben maar sneller en nauwkeuriger werken. Begrijpen hoe de encoder-decoder-structuur werkt, geeft je inzicht in hoe bijna alle taalmodellen hun magie doen.

Veelgestelde vragen over Seq2Seq

De drie meest gestelde vragen over dit onderwerp, kort beantwoord.

Wat is Seq2Seq?

Een AI-architectuur die een reeks invoer (bv. een zin in het Engels) omzet naar een reeks uitvoer (bv. diezelfde zin in het Frans) — de basis voor vertaalmachines en chatbots.

Waarom is Seq2Seq belangrijk?

Seq2Seq (kort voor sequence-to-sequence) is een AI-architectuur die een reeks van informatie — bijvoorbeeld woorden in een zin — leest en vervolgens een nieuwe reeks produceert. Stel je voor dat je een recept in het Engels leest en het vervolgens in het Nederlands navertelt: je neemt de volgorde van stappen in, verwerkt ze, en zet ze om in een nieuwe volgorde woorden. Precies dat doet Seq2Seq: het leest de invoer van links naar rechts, comprimeert de betekenis in een soort 'gedachte', en rolt daar een nieuwe reeks uitvoer uit.

Hoe wordt Seq2Seq toegepast?

Deze architectuur bestaat uit twee delen: een encoder en een decoder. De encoder leest de invoer woord voor woord en bouwt een interne representatie op — een soort samenvatting van wat er gezegd is. De decoder neemt die samenvatting en produceert daar woord voor woord de uitvoer uit. Denk aan een tolk: die luistert naar een hele zin (encoder), begrijpt de kern, en spreekt vervolgens de vertaling uit (decoder).