Wat is Oversampling?

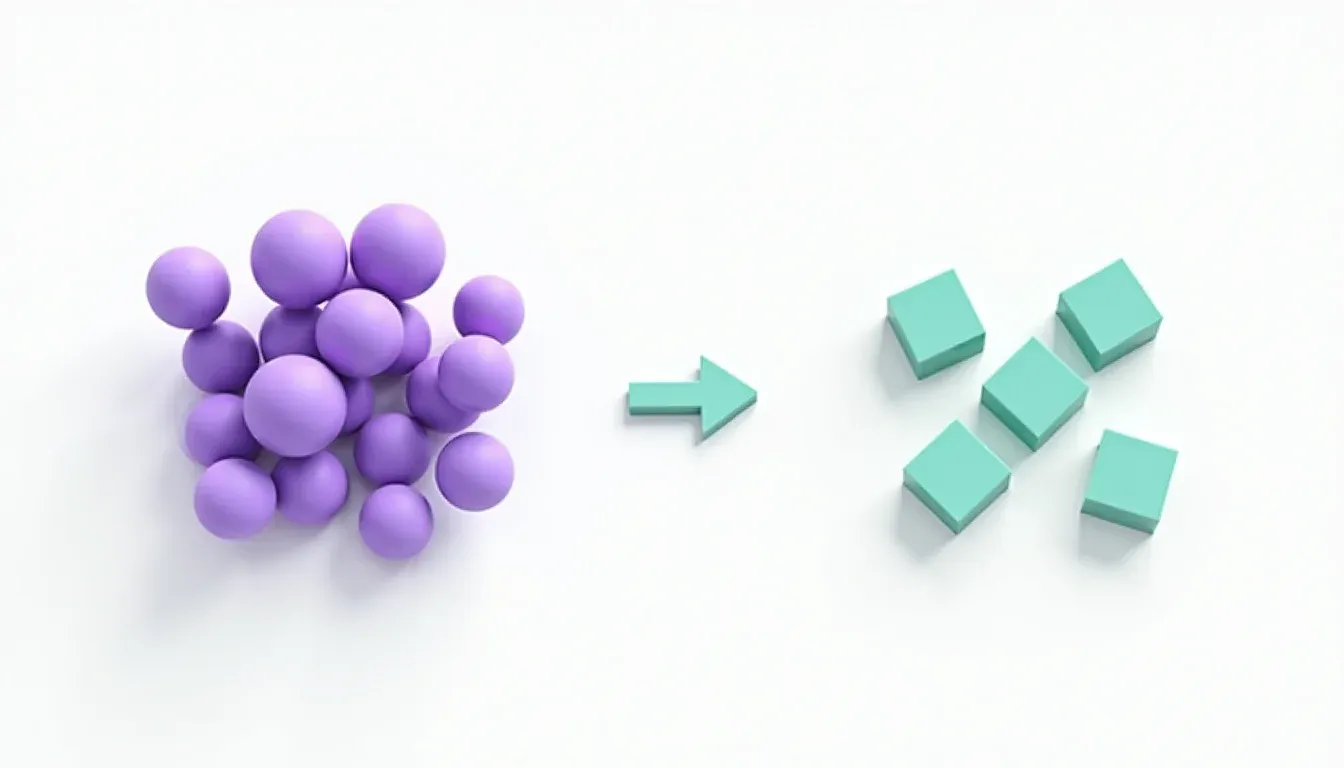

Een techniek waarbij je extra kopieën maakt van ondervertegenwoordigde voorbeelden in je dataset, zodat je AI-model niet alleen leert van de meest voorkomende gevallen.

Wat is oversampling eigenlijk?

Stel je voor dat je een AI-model traint om ziektes te herkennen op medische scans. In je dataset heb je 950 foto's van gezonde longen en maar 50 van longen met een zeldzame aandoening. Als je het model zomaar laat leren, wordt het een expert in het herkennen van gezonde longen — maar die zeldzame ziekte? Die leert het nauwelijks. Het gaat gewoon overal "gezond" roepen omdat dat in 95% van de gevallen klopt.

Oversampling is de techniek waarbij je die 50 zeldzame gevallen kunstmatig vaker laat terugkomen in de training. Je maakt er bijvoorbeeld kopieën van, zodat het model ze net zo vaak ziet als de gezonde longen. Simpelweg dupliceren is de meest basale vorm, maar er bestaan ook slimmere varianten waarbij je licht aangepaste versies maakt (een foto iets draaien, kleuren aanpassen) of zelfs nieuwe synthetische voorbeelden genereert.

Het is eigenlijk alsof je een leerling die slecht is in breuken extra rekenopgaves met breuken geeft, terwijl de rest van de klas doorwerkt. Zo krijgt iedereen evenveel aandacht.

Waarom heb je dit nodig?

In de praktijk zijn datasets bijna nooit perfect uitgebalanceerd. Fraude komt veel minder voor dan normale transacties. Zeldzame ziektes komen — logischerwijs — zelden voor. Spamberichten zijn een minderheid in je inbox (hopelijk). Als je niks doet, leert je model vooral van de meerderheid en negeert het de rest.

Dat heet een "imbalanced dataset" — een dataset waarin bepaalde categorieën veel vaker voorkomen dan andere. En dat leidt tot voorspellingen die statistisch gezien correct lijken ("95% van de tijd zit ik goed!"), maar compleet nutteloos zijn voor de gevallen die er juist toe doen. Een fraudedetectiesysteem dat nooit fraude herkent, is geen haar beter dan geen systeem.

Oversampling zorgt ervoor dat je model leert dat die zeldzame gevallen net zo belangrijk zijn. Het krijgt ze vaker onder ogen, waardoor het patronen gaat herkennen in plaats van ze te negeren.

Hoe werkt het in de praktijk?

De simpelste vorm: je dupliceert gewoon de voorbeelden van de minderheidsklasse totdat je evenveel hebt als van de meerderheidsklasse. Klinkt te makkelijk om waar te zijn? Dat is het ook een beetje — want je model ziet dan exact dezelfde voorbeelden steeds opnieuw, waardoor het die specifieke voorbeelden uit z'n hoofd leert in plaats van de onderliggende patronen te begrijpen.

Daarom bestaan er slimmere varianten:

Random oversampling met variatie: je maakt kopieën, maar past ze subtiel aan (een foto spiegelen, een zinnetje herformuleren)

SMOTE (Synthetic Minority Oversampling Technique): een algoritme dat nieuwe synthetische voorbeelden genereert door bestaande voorbeelden te combineren — alsof je uit twee foto's van zieke longen een derde, licht verschillende versie maakt

ADASYN: een verfijning van SMOTE die zich vooral richt op de moeilijkste gevallen binnen de minderheidsklasse

De keerzijde: als je overdrijft, krijg je "overfitting" — je model wordt té goed in die zeldzame gevallen en verliest z'n algemene inzicht. Het is een delicaat evenwicht.

Een voorbeeld uit het bedrijfsleven

Een online webshop wil voorspellen welke klanten binnenkort waarschijnlijk stoppen met bestellen. Van de 100.000 klanten in hun database zijn er 5.000 die in de afgelopen maanden zijn gestopt. Die 5% is cruciaal — dat zijn de mensen die je wilt terugwinnen.

Zonder oversampling leert het AI-model vooral wat "blijvers" kenmerkt, want dat is 95% van de data. Met oversampling geef je die 5.000 stoppers extra gewicht: je kopieert hun gedragspatronen, voegt subtiele variaties toe (iemand die drie weken niet bestelde wordt ook een voorbeeld van iemand die twee weken niet bestelde), en traint het model opnieuw.

Resultaat: het herkent nu veel beter de signalen van dreigende klantuitval — en de marketingafdeling kan op tijd ingrijpen met een gepersonaliseerde aanbieding.

Waar kom je het tegen?

Oversampling wordt breed toegepast:

Medische AI: diagnose van zeldzame ziektes, kankerdetectie

Fraude-detectie: banken, verzekeraars, betalingssystemen

Kwaliteitscontrole: productiefouten opsporen (defecten zijn zeldzaam)

Churn prediction: welke klanten/abonnees dreigen weg te lopen

Sentimentanalyse: als negatieve reviews ondervertegenwoordigd zijn

Spam-filters: spam is vaak een kleine minderheid in trainingsdata

Libraries zoals scikit-learn (Python) en imbalanced-learn bieden kant-en-klare functies voor diverse oversampling-technieken. Ook in tools zoals Azure Machine Learning en Google Vertex AI zijn er standaard opties voor data-balancing.

Wat kun je er nu mee?

Als je zelf een AI-model traint — of iemand inhuurt om dat te doen — is het slim om eerst te checken of je dataset uitgebalanceerd is. Heb je van alles wat je wilt herkennen genoeg voorbeelden? Zo niet, overweeg dan oversampling (of z'n tegenhanger: undersampling, waarbij je juist voorbeelden van de meerderheid weggooit).

Denk vooral goed na over wat "genoeg" is. Een model dat perfect werkt op papier maar in de praktijk de zeldzame gevallen mist, is waardeloos. Oversampling helpt je model om ook echt te leren van wat schaars maar belangrijk is — en dat maakt vaak het verschil tussen een leuk experiment en een nuttig systeem.

Veelgestelde vragen over Oversampling

De drie meest gestelde vragen over dit onderwerp, kort beantwoord.

Wat is Oversampling?

Een techniek waarbij je extra kopieën maakt van ondervertegenwoordigde voorbeelden in je dataset, zodat je AI-model niet alleen leert van de meest voorkomende gevallen.

Waarom is Oversampling belangrijk?

Stel je voor dat je een AI-model traint om ziektes te herkennen op medische scans. In je dataset heb je 950 foto's van gezonde longen en maar 50 van longen met een zeldzame aandoening. Als je het model zomaar laat leren, wordt het een expert in het herkennen van gezonde longen — maar die zeldzame ziekte? Die leert het nauwelijks. Het gaat gewoon overal "gezond" roepen omdat dat in 95% van de gevallen klopt.

Hoe wordt Oversampling toegepast?

Oversampling is de techniek waarbij je die 50 zeldzame gevallen kunstmatig vaker laat terugkomen in de training. Je maakt er bijvoorbeeld kopieën van, zodat het model ze net zo vaak ziet als de gezonde longen. Simpelweg dupliceren is de meest basale vorm, maar er bestaan ook slimmere varianten waarbij je licht aangepaste versies maakt (een foto iets draaien, kleuren aanpassen) of zelfs nieuwe synthetische voorbeelden genereert.