Wat is Gradient Descent?

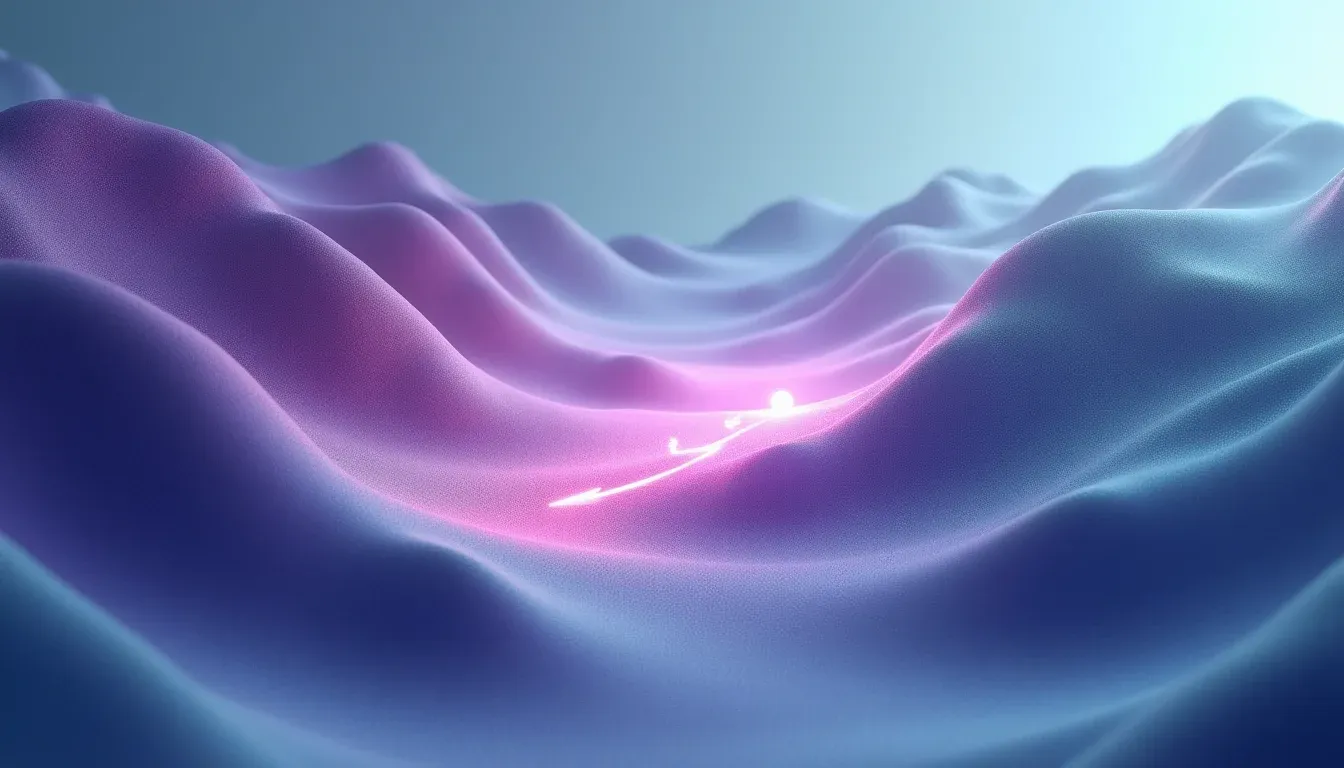

Een stap-voor-stap methode waarmee een AI-model leert door telkens kleine aanpassingen te maken richting de beste oplossing — vergelijkbaar met afdalen van een berg in de mist.

Hoe werkt het eigenlijk?

Stel je voor dat je 's nachts op een berg staat en naar beneden wilt. Je ziet geen pad, alleen de grond direct onder je voeten. Je voelt met je schoen waar het bergafwaarts gaat en zet een klein stapje die kant op. Dan voel je weer, zet weer een stapje. Zo kom je uiteindelijk bij het dal.

Dat is precies hoe Gradient Descent werkt. Een AI-model moet leren — en 'leren' betekent hier: de beste instellingen vinden waarmee het de juiste antwoorden geeft. Maar er zijn vaak miljoenen mogelijke instellingen. Het model begint met willekeurige waardes (het staat bovenop de berg) en moet naar de beste combinatie toe (het dal, waar de fout het kleinst is).

Het model kijkt telkens: "Als ik deze instelling een beetje verander, wordt mijn fout dan groter of kleiner?" Die richting heet de gradient (helling). Vervolgens past het de instelling een klein stukje aan in de richting van minder fout. Dat heet descent (afdalen). Dit herhaalt het duizenden of miljoenen keren, tot het model goed genoeg is.

Een voorbeeld uit de praktijk

Stel: je traint een model om huizenprijzen te voorspellen. Het begint met een wilde gok: "Elke vierkante meter is 500 euro waard." Dat klopt niet — de voorspellingen zijn ver naast de werkelijke prijzen.

Het model berekent hoeveel fout het maakt, en kijkt dan: "Als ik dat getal verander naar 510 euro per vierkante meter, wordt de fout dan kleiner?" Ja? Dan past het dat aan. Weer checken. Weer aanpassen. Na duizenden van die stapjes zit het model bijvoorbeeld op 2.300 euro per vierkante meter, en klopt de voorspelling veel beter.

Dat is Gradient Descent in actie: kleine, gerichte stapjes richting de beste oplossing.

Waarom is het belangrijk?

Zonder Gradient Descent zouden AI-modellen niet kunnen leren. Het is de motor achter bijna alle moderne neurale netwerken — van chatbots tot beeldherkenning tot aanbevelingssystemen. Elk model dat je tegenkomt, heeft waarschijnlijk Gradient Descent gebruikt tijdens het leren.

Het proces is simpel in idee, maar krachtig. Het werkt zelfs bij enorm complexe problemen met miljoenen instellingen, omdat het telkens alleen kijkt naar de lokale richting: "Welke kant op moet ik nu?"

Waar kom je het tegen?

Gradient Descent zit ingebakken in vrijwel alle AI-frameworks en -tools:

TensorFlow en PyTorch — de twee grote frameworks waarmee ontwikkelaars AI-modellen bouwen, gebruiken standaard varianten van Gradient Descent

Keras — een laag bovenop TensorFlow, maakt Gradient Descent toegankelijker voor beginners

Scikit-learn — ook hier draait veel training op Gradient Descent-principes

JAX, MXNet, ONNX — allemaal moderne frameworks die dit mechanisme toepassen

Je ziet het ook terug in combinatie met termen als learning rate (hoe groot zijn die stapjes?) of optimizer (welke slimme variant van Gradient Descent gebruiken we?). Varianten zoals Stochastic Gradient Descent of Adam zijn verfijningen die sneller of stabieler werken.

Wat kun je ermee?

Als je zelf AI-modellen gaat trainen, kom je Gradient Descent vanzelf tegen — vaak zonder dat je het merkt. De meeste tools doen het automatisch. Maar het helpt enorm om te begrijpen wat er gebeurt: waarom duurt training soms lang? Waarom raakt een model soms 'vast' in een slechte oplossing? Waarom zijn bepaalde instellingen (zoals de stapgrootte) zo belangrijk?

Met dit begrip kun je beter inschatten wanneer een model klaar is, wanneer het vastloopt, en hoe je de training kunt versnellen. Het maakt AI minder een black box en meer een proces dat je begrijpt — stap voor stap, net als die afdaling van de berg.

Veelgestelde vragen over Gradient Descent

De drie meest gestelde vragen over dit onderwerp, kort beantwoord.

Wat is Gradient Descent?

Een stap-voor-stap methode waarmee een AI-model leert door telkens kleine aanpassingen te maken richting de beste oplossing — vergelijkbaar met afdalen van een berg in de mist.

Waarom is Gradient Descent belangrijk?

Stel je voor dat je 's nachts op een berg staat en naar beneden wilt. Je ziet geen pad, alleen de grond direct onder je voeten. Je voelt met je schoen waar het bergafwaarts gaat en zet een klein stapje die kant op. Dan voel je weer, zet weer een stapje. Zo kom je uiteindelijk bij het dal.

Hoe wordt Gradient Descent toegepast?

Dat is precies hoe Gradient Descent werkt. Een AI-model moet leren — en 'leren' betekent hier: de beste instellingen vinden waarmee het de juiste antwoorden geeft. Maar er zijn vaak miljoenen mogelijke instellingen. Het model begint met willekeurige waardes (het staat bovenop de berg) en moet naar de beste combinatie toe (het dal, waar de fout het kleinst is).