Wat is Gradient?

De richting waarin een AI-model het snelst kan verbeteren — zoals het steilste pad van een berg af, maar dan voor foutcorrectie.

Wat is een gradient eigenlijk?

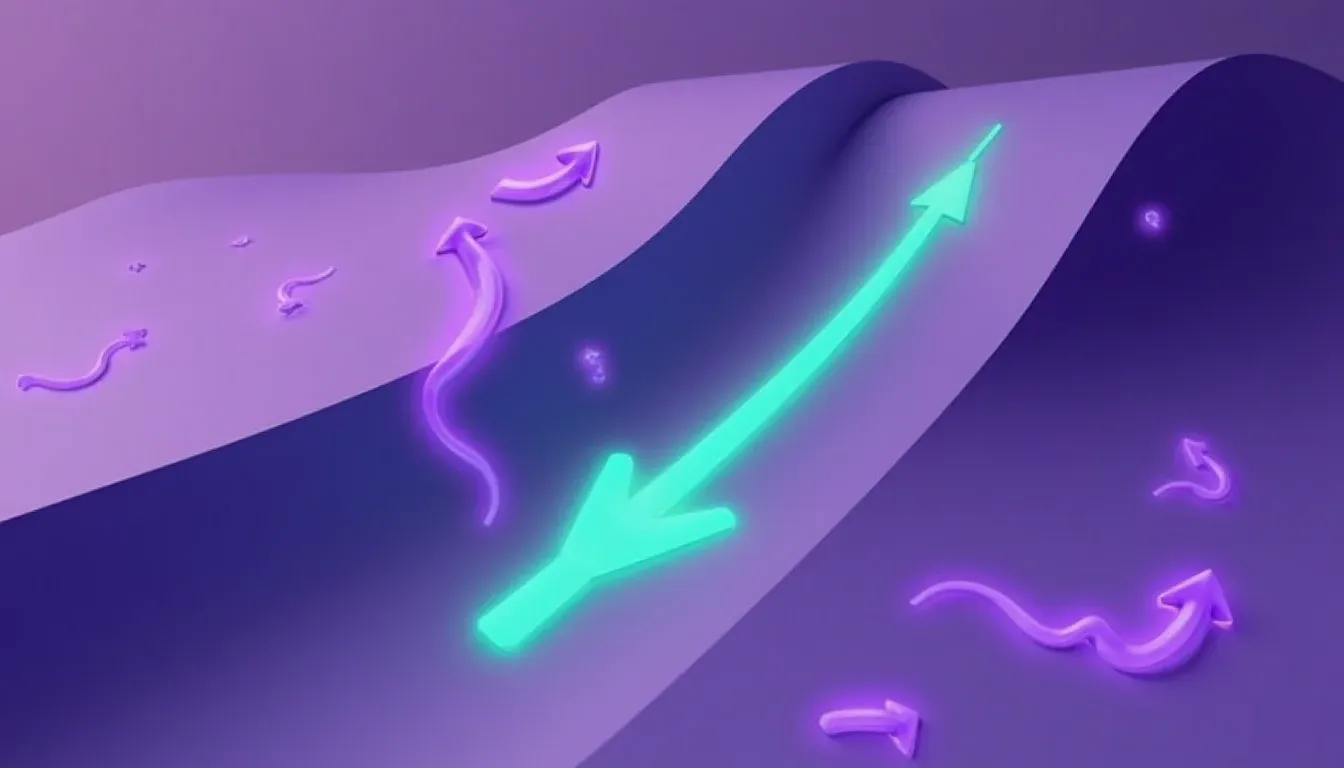

Stel je voor dat je met een blinddoek op een heuvel staat en terug naar beneden moet. Je voelt met je voet: in welke richting helt de grond het sterkst? Dat is de richting waarin je het snelst afdaalt. Een gradient is precies dat, maar dan voor een AI-model: het geeft aan in welke richting en hoe sterk het model zijn instellingen moet aanpassen om sneller beter te worden.

Wanneer een AI-model leert — bijvoorbeeld om katten op foto's te herkennen — maakt het eerst veel fouten. Al die fouten samen vormen een soort 'foutscore', ook wel een loss genoemd. Het doel is om die score zo laag mogelijk te krijgen. De gradient wijst het model de weg: "Als je dít gewichtje een beetje meer naar links draait, zakt je foutscore het snelst."

Hoe werkt het in de praktijk?

Een neuraal netwerk heeft duizenden of miljoenen kleine instelknopjes (parameters). Na elke voorspelling berekent het systeem: hoeveel droeg elk knopje bij aan de fout? Die berekening heet backpropagation — het terugrekenen van de fout door het netwerk. Het resultaat is een gradient: een verzameling richtingaanwijzingen voor al die knopjes.

Denk aan een groot bedrijfsdashboard met duizenden schuifjes. De gradient vertelt je: "Schuifje 1 moet 0,03 naar rechts, schuifje 2 moet 0,15 naar links, schuifje 3 blijft staan" — allemaal tegelijk, zodat de totale fout kleiner wordt. Het model neemt dan een stapje in die richting. Dat ene stapje heet een gradient descent step.

Waarom is dit zo belangrijk?

Zonder gradient zou een AI-model willekeurig knopjes draaien en hopen dat het beter wordt. Dat zou maanden duren. De gradient maakt het leerproces efficiënt: het model weet precies waar het aan moet draaien en hoeveel. Alle moderne AI — van ChatGPT tot beeldherkenning in je smartphone — leert via deze methode.

Soms is de gradient heel groot (steile helling), dan maakt het model grote stappen. Soms is de gradient klein (vlak terrein), dan gaat het voorzichtig. Als de gradient nul is, staat het model op een dal of top — dan is het klaar met leren, of vast komen te zitten.

Een voorbeeld uit de praktijk

Stel: je traint een AI om spammail te herkennen. Het model begint met willekeurige instellingen en classificeert 70% verkeerd. Na elke batch e-mails berekent het de gradient: "Ik moet meer gewicht geven aan woorden als 'gratis' en 'winnaar', en minder aan neutrale woorden als 'vergadering'." Het past zijn interne gewichten aan. Na duizenden stappen is de foutscore gedaald van 70% naar 2%.

Waar kom je het tegen?

De term 'gradient' zie je vooral in technische documentatie en AI-cursussen, maar het principe werkt achter de schermen in:

ChatGPT, Claude, Gemini — getraind met miljarden gradient-stappen

Beeldherkenning in Google Photos, Apples Face ID

Aanbevelingsalgoritmes op Netflix, Spotify, YouTube

Zelfrijdende auto's — leren sturen door gradients te volgen

Vertaalsystemen zoals DeepL en Google Translate

Elke keer dat je hoort dat een model 'getraind is op data', is dat gebeurd door het volgen van miljarden gradients.

Wat kun je er nu mee?

Je hoeft geen gradients te berekenen om AI te gebruiken, maar als je begrijpt hoe ze werken, snap je waarom:

AI-modellen soms vastlopen (de gradient wordt te klein)

Training zoveel rekenkracht kost (miljarden gradient-berekeningen)

Meer data vaak helpt (betere gradients, duidelijker richting)

Finetuning mogelijk is (je volgt de gradient verder vanaf een startpunt)

Als je zelf met AI aan de slag gaat — bijvoorbeeld een model traint of finetunet — zie je soms grafieken van 'gradient norm' of 'loss curve'. Die laten zien hoe snel het model leert. Een te grote gradient? Dan springt het model heen en weer. Te klein? Dan duurt het eindeloos. De kunst is om de gradient precies goed te volgen — en dat is waar technieken als learning rate en optimizers bij helpen.

Veelgestelde vragen over Gradient

De drie meest gestelde vragen over dit onderwerp, kort beantwoord.

Wat is Gradient?

De richting waarin een AI-model het snelst kan verbeteren — zoals het steilste pad van een berg af, maar dan voor foutcorrectie.

Waarom is Gradient belangrijk?

Stel je voor dat je met een blinddoek op een heuvel staat en terug naar beneden moet. Je voelt met je voet: in welke richting helt de grond het sterkst? Dat is de richting waarin je het snelst afdaalt. Een gradient is precies dat, maar dan voor een AI-model: het geeft aan in welke richting en hoe sterk het model zijn instellingen moet aanpassen om sneller beter te worden.

Hoe wordt Gradient toegepast?

Wanneer een AI-model leert — bijvoorbeeld om katten op foto's te herkennen — maakt het eerst veel fouten. Al die fouten samen vormen een soort 'foutscore', ook wel een loss genoemd. Het doel is om die score zo laag mogelijk te krijgen. De gradient wijst het model de weg: "Als je dít gewichtje een beetje meer naar links draait, zakt je foutscore het snelst."