Wat is Variance?

Variance meet hoe ver getallen van elkaar afwijken. In AI: hoe grillig een model reageert op nieuwe data — hoge variance betekent dat het te veel op specifieke voorbeelden let en daarom wisselvallig wordt.

Wat is variance eigenlijk?

Variance is een statistisch begrip dat meet hoe verspreid getallen zijn. Stel je voor dat je elke dag de aankomsttijd van je trein noteert. Als die ene keer 8:02, dan 8:01, dan 8:03 is — lage variance, prettig voorspelbaar. Maar als het de ene dag 7:55 is en de volgende dag 8:15 — hoge variance, irritant onvoorspelbaar.

In AI werkt het precies zo. Een model met lage variance geeft consistente antwoorden, zelfs als je iets anders vraagt of net andere data aanbiedt. Een model met hoge variance schommelt alle kanten op: de ene keer raak, de andere keer compleet ernaast.

Hoe ontstaat hoge variance in AI?

Hoge variance komt vaak doordat een model té goed naar zijn trainingsdata heeft gekeken. Het heeft niet alleen de grote patronen geleerd ("honden hebben vier poten"), maar ook toevallige details ("die ene hond stond altijd op een groen grasveld"). Als het dan een hond op asfalt ziet, raakt het in de war.

Denk aan een student die alle examenvragen van vorig jaar uit zijn hoofd leert, inclusief de schrijffouten. Die haalt misschien een 10 voor dát exacte examen, maar zakt compleet als de vragen nét anders worden gesteld. Dat is hoge variance: te specifiek, te weinig flexibel.

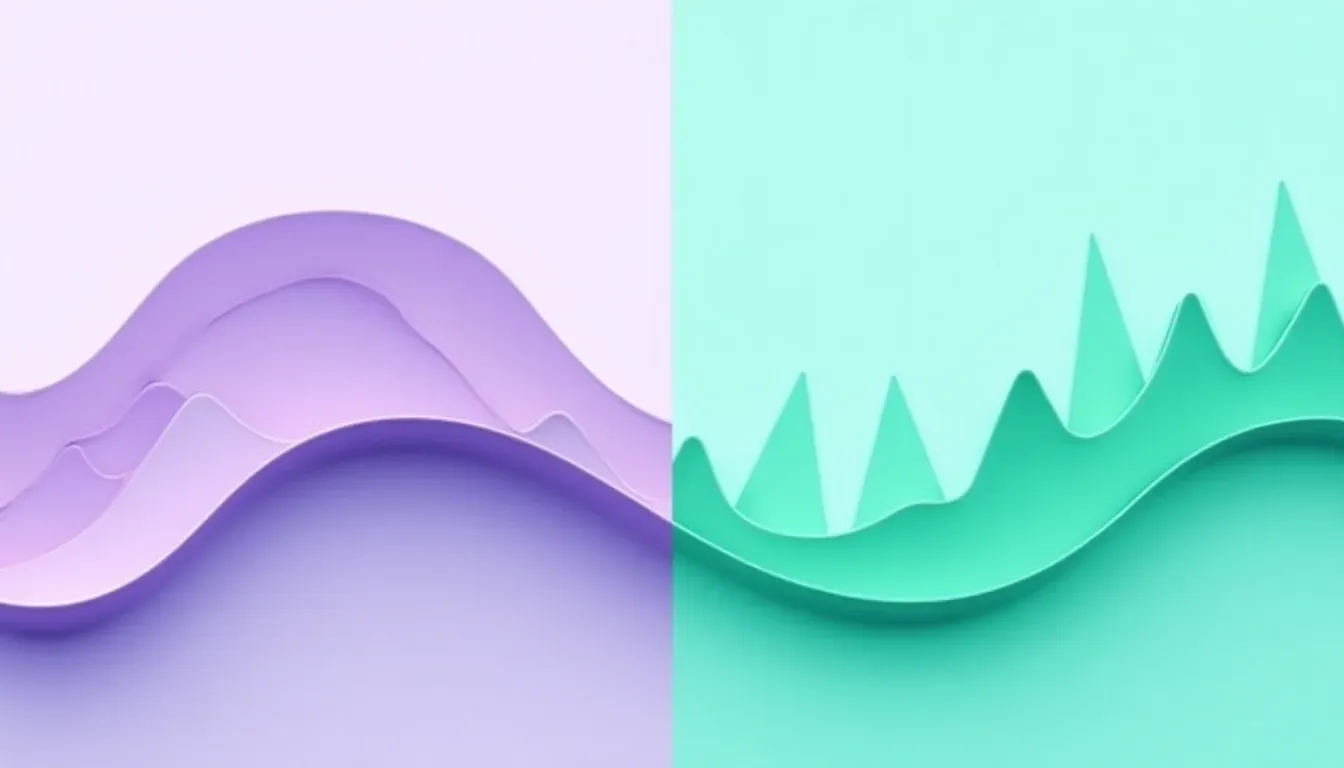

Het evenwicht: bias en variance

In machine learning praat je vaak over de bias-variance trade-off. Bias betekent dat je model te simpel is ("alle dieren zijn katten"). Variance betekent dat het te grillig is ("dit dier heeft drie witte vlekken, dus het is een kat, maar dat dier heeft vier witte vlekken, dus het is een hond").

Je ideale model zit ertussenin: het vangt de échte patronen, maar laat losse ruis voor wat het is. Als je variance verlaagt (bijvoorbeeld door je model simpeler te maken of meer trainingsdata te gebruiken), loop je het risico dat je bias omhooggaat. Te simpel model, te weinig nuance. Het is een constant balanceren.

Waar kom je het tegen?

Je merkt hoge variance vooral bij:

Kleine datasets — als je een model op 50 foto's traint, leert het vaak die 50 foto's uit zijn hoofd in plaats van algemene regels

Complexe modellen — een neuraal netwerk met miljoenen parameters kan elk detail onthouden, en doet dat ook als je niet oppast

Overfitting — de technische term voor "te hoge variance"; het model past perfect op de trainingsdata maar faalt op nieuwe voorbeelden

Cross-validatie — een techniek waarbij je data in stukjes knipt om te testen of je model consistent blijft; hoge verschillen tussen testrondes wijzen op hoge variance

Tools zoals scikit-learn, TensorFlow en PyTorch bieden ingebouwde functies om variance te monitoren (bijvoorbeeld door validatie-scores te vergelijken). Bij het trainen van modellen zoals GPT of Stable Diffusion wordt variance actief beperkt door enorme datasets en regularisatietechnieken.

Hoe verlaag je variance?

Er zijn een paar praktische trucs:

Meer data — hoe meer voorbeelden, hoe moeilijker het wordt om ze allemaal uit je hoofd te leren

Regularisatie — technieken die je model "straffen" als het te complex wordt (zoals L2-regularisatie of dropout)

Ensemble-methoden — meerdere modellen trainen en hun voorspellingen middelen; zo heffen extreme uitschieters elkaar op

Eenvoudiger architectuur — minder lagen, minder parameters, minder kans op grilligheden

Als je zelf AI-modellen traint, let dan op grote verschillen tussen je training accuracy (hoe goed het op bekende data scoort) en test accuracy (hoe goed het op nieuwe data scoort). Een groot verschil? Dan heb je waarschijnlijk te maken met hoge variance.

Waarom zou jij hier iets aan hebben?

Als je begrijpt wat variance is, kun je beter beoordelen waarom een AI-systeem soms fantastisch werkt en soms compleet de mist in gaat. Het helpt je ook om kritischer te zijn op demo's: een model dat perfect werkt op de voorbeelden die je ziet, kan alsnog waardeloos zijn op jouw specifieke situatie — dat is hoge variance in actie.

Bij het inkopen of bouwen van AI-oplossingen: vraag altijd naar resultaten op onbekende data, niet alleen op de trainingsset. En als je zelf experimenteert met modellen (bijvoorbeeld via AutoML-platforms of no-code tools), let op waarschuwingen over overfitting — dat is meestal een variance-alarm.

Veelgestelde vragen over Variance

De drie meest gestelde vragen over dit onderwerp, kort beantwoord.

Wat is Variance?

Variance meet hoe ver getallen van elkaar afwijken. In AI: hoe grillig een model reageert op nieuwe data — hoge variance betekent dat het te veel op specifieke voorbeelden let en daarom wisselvallig wordt.

Waarom is Variance belangrijk?

Variance is een statistisch begrip dat meet hoe verspreid getallen zijn. Stel je voor dat je elke dag de aankomsttijd van je trein noteert. Als die ene keer 8:02, dan 8:01, dan 8:03 is — lage variance, prettig voorspelbaar. Maar als het de ene dag 7:55 is en de volgende dag 8:15 — hoge variance, irritant onvoorspelbaar.

Hoe wordt Variance toegepast?

In AI werkt het precies zo. Een model met lage variance geeft consistente antwoorden, zelfs als je iets anders vraagt of net andere data aanbiedt. Een model met hoge variance schommelt alle kanten op: de ene keer raak, de andere keer compleet ernaast.