Wat is Quantization?

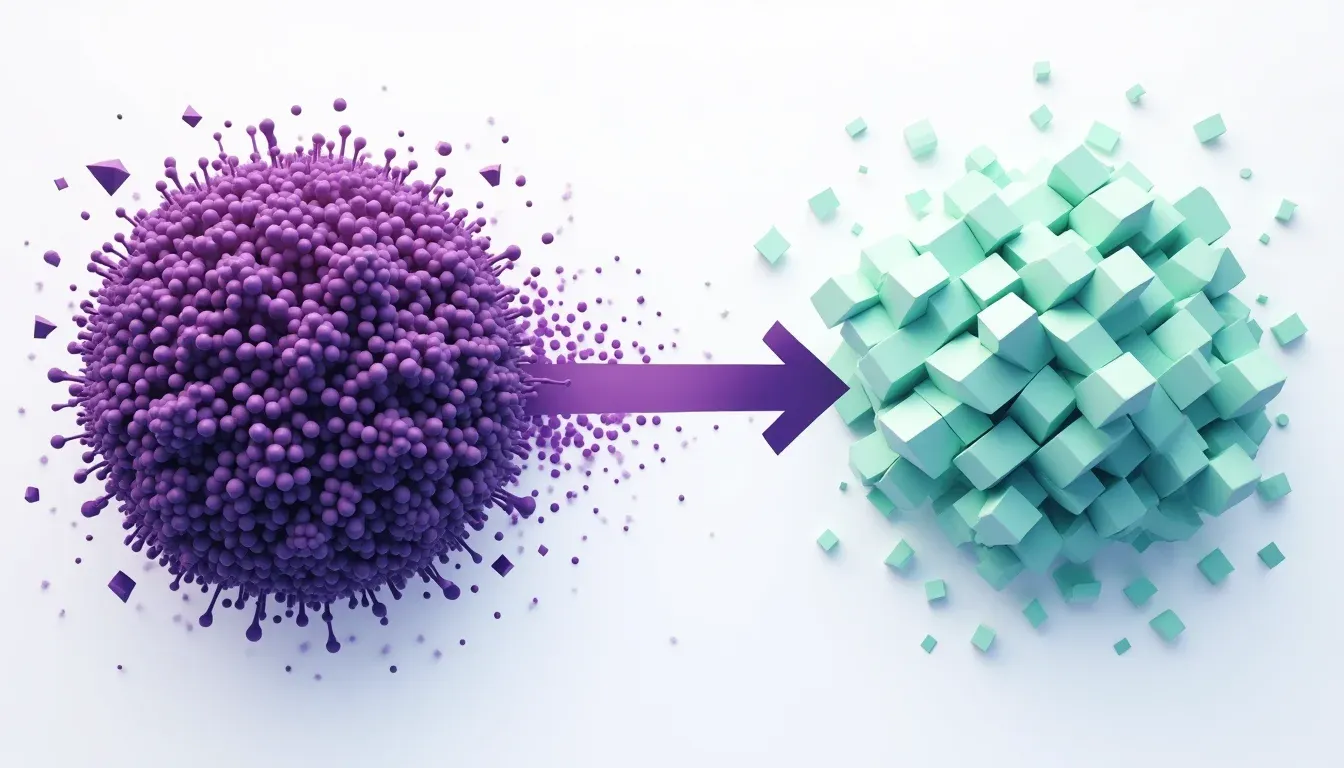

Quantization maakt AI-modellen kleiner en sneller door getallen met minder precisie op te slaan — zoals een foto verkleinen van 4K naar HD, waardoor hij minder ruimte inneemt.

Wat is quantization eigenlijk?

Stel je voor: je hebt een prachtige foto van je vakantie in 4K-kwaliteit. Die neemt 50 MB in beslag op je telefoon. Als je hem verkleinst naar HD-kwaliteit, past hij in 5 MB — en op je telefoonscherm zie je nauwelijks verschil. Dat principe heet quantization, en AI-modellen gebruiken het op precies dezelfde manier.

Als een AI-model wordt getraind, gebruikt het super-precieze getallen om alle details te onthouden. Elk gewicht in het neurale netwerk wordt opgeslagen als een 32-bits getal — alsof je de temperatuur meet tot op vijf cijfers achter de komma. Dat is extreem nauwkeurig, maar kost enorm veel geheugen en rekenkracht.

Quantization verlaagt die precisie naar bijvoorbeeld 8-bits, 4-bits of zelfs 2-bits. Je verliest een beetje nauwkeurigheid, maar het model wordt ineens 4 tot 8 keer kleiner. Het reageert ook veel sneller, omdat je computer minder gegevens hoeft te verwerken. Voor de meeste taken merk je nauwelijks verschil in kwaliteit — net zoals die HD-foto op je telefoon nog steeds prachtig is.

Waarom zou jij hier iets aan hebben?

Als je ooit geprobeerd hebt een groot AI-model lokaal op je laptop te draaien, ken je het probleem: je RAM loopt vol, je ventilator gaat als een gek tekeer, en na tien minuten geeft je computer het op. Quantization lost dat op.

Een gedownload taalmodel van 13 miljard parameters kan in zijn originele vorm 26 GB geheugen vragen. Met 4-bits quantization past diezelfde model in 7 GB — en draait hij opeens wel soepel op je MacBook of gaming-PC. Bedrijven gebruiken quantization om duizenden euro's per maand te besparen op cloud-rekenkracht, omdat ze kleinere servers kunnen huren.

Ook voor mobiele apps is het cruciaal. Als je AI-functies in een smartphone-app wilt stoppen (denk aan offline spraakherkenning of slimme foto-editing), moet het model compact genoeg zijn. Quantization maakt dat mogelijk.

Hoe werkt het in de praktijk?

Er zijn verschillende gradaties:

16-bits (FP16 of BF16): halveert de grootte, behoud bijna alle kwaliteit — standaard bij veel moderne GPU's

8-bits (INT8): kwart van de originele grootte, nog steeds prima bruikbaar voor de meeste taken

4-bits (INT4): achtste van de grootte, klein verlies aan precisie maar nog steeds verrassend goed

2-bits of lager: extreem compact, maar je ziet duidelijk kwaliteitsverlies — vooral geschikt voor eenvoudige taken

De kunst is om het zoete punt te vinden: zo compact mogelijk, zonder dat het model domme fouten gaat maken. Bij moderne quantization-technieken wordt het model soms "gecalibreerd" — er wordt gekeken welke gewichten echt belangrijk zijn, en die krijgen net iets meer precisie dan de rest.

Waar kom je het tegen?

Je gebruikt quantization waarschijnlijk vaker dan je denkt:

Ollama, LM Studio, GPT4All: tools om grote taalmodellen lokaal te draaien gebruiken standaard gequantizeerde versies (vaak met de extensie .Q4, .Q5, .Q8 in de bestandsnaam)

Apple Intelligence, Google Pixel AI: AI-functies op je telefoon draaien via gequantizeerde modellen — anders zou je batterij binnen een uur leeg zijn

Hugging Face: veel modellen zijn beschikbaar in zowel originele als gequantizeerde versies (zoek op "quantized" of "GGUF", "GPTQ", "AWQ")

ONNX Runtime, TensorFlow Lite: frameworks die automatisch quantization toepassen voor snelle inferentie

Cloud-AI diensten: ook bedrijven als OpenAI, Anthropic en Google gebruiken quantization achter de schermen om kosten te drukken

Moet je er iets mee?

Als je AI-modellen wilt gebruiken zonder een datacenter in je kelder te bouwen, is quantization je beste vriend. Het maakt lokaal experimenteren mogelijk, versnelt productie-systemen en verlaagt je maandelijkse cloud-factuur.

Wil je een open-source model downloaden? Kijk of er een 4-bits of 8-bits versie beschikbaar is — je laptop zal je dankbaar zijn. En als je een eigen model traint en wilt uitrollen, vraag je framework of platform dan naar quantization-opties. Je kunt vaak 70-80% van je servercapaciteit besparen zonder dat gebruikers het verschil merken.

Veelgestelde vragen over Quantization

De drie meest gestelde vragen over dit onderwerp, kort beantwoord.

Wat is Quantization?

Quantization maakt AI-modellen kleiner en sneller door getallen met minder precisie op te slaan — zoals een foto verkleinen van 4K naar HD, waardoor hij minder ruimte inneemt.

Waarom is Quantization belangrijk?

Stel je voor: je hebt een prachtige foto van je vakantie in 4K-kwaliteit. Die neemt 50 MB in beslag op je telefoon. Als je hem verkleinst naar HD-kwaliteit, past hij in 5 MB — en op je telefoonscherm zie je nauwelijks verschil. Dat principe heet quantization, en AI-modellen gebruiken het op precies dezelfde manier.

Hoe wordt Quantization toegepast?

Als een AI-model wordt getraind, gebruikt het super-precieze getallen om alle details te onthouden. Elk gewicht in het neurale netwerk wordt opgeslagen als een 32-bits getal — alsof je de temperatuur meet tot op vijf cijfers achter de komma. Dat is extreem nauwkeurig, maar kost enorm veel geheugen en rekenkracht.