Wat is Kernel Trick?

Een wiskundige truc die zorgt dat Machine Learning-modellen patronen kunnen herkennen in data die niet in een rechte lijn te scheiden zijn — zonder dat je de data eerst zelf hoeft om te vormen.

Waar heb je het voor nodig?

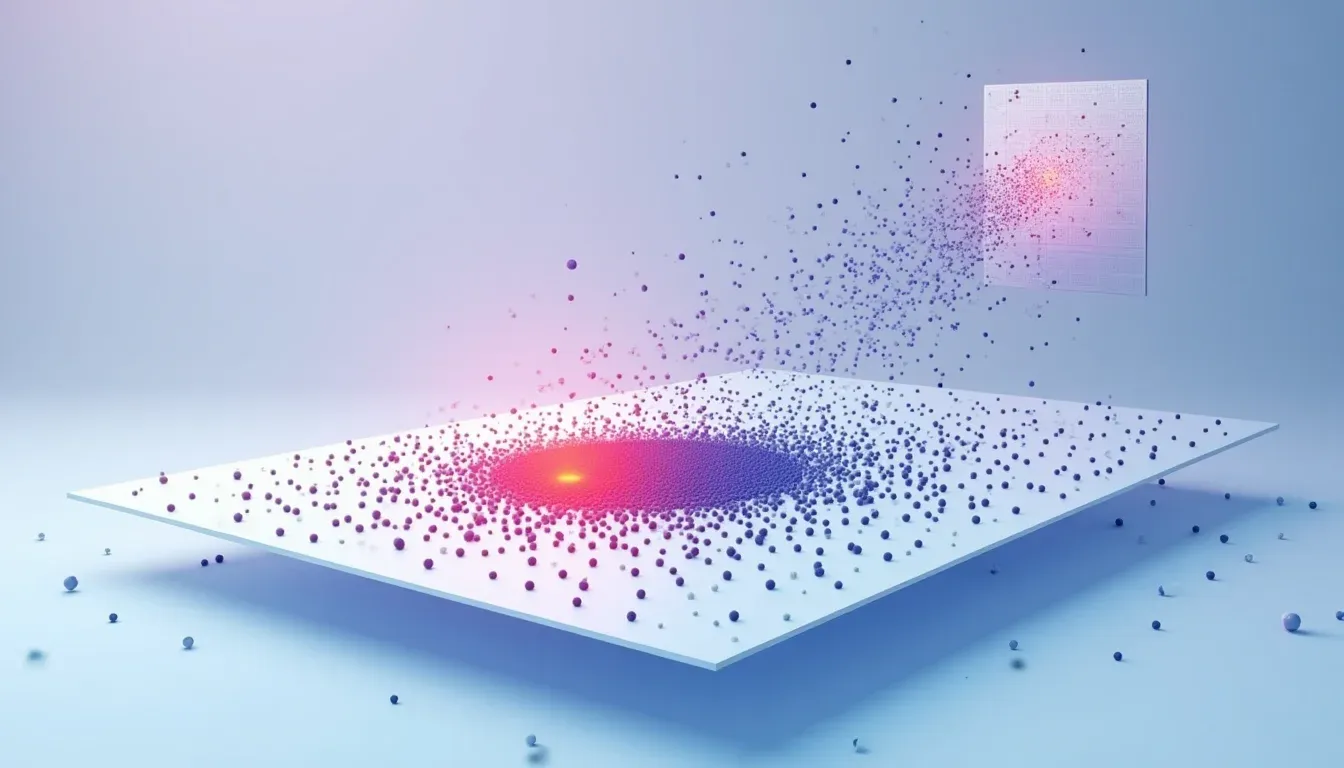

Stel je voor: je hebt een groep rode en blauwe punten op papier, en je wilt een lijn trekken die de twee kleuren scheidt. Als alle rode punten links zitten en alle blauwe rechts, is dat makkelijk — trek gewoon een verticale streep ertussen. Maar wat als de rode punten in een cirkel zitten, met de blauwe punten eromheen? Dan kun je geen rechte lijn meer trekken die ze netjes scheidt.

De Kernel Trick is een slimme oplossing voor dit probleem. Het is een wiskundige techniek die vooral gebruikt wordt bij een klassiek Machine Learning-algoritme genaamd een Support Vector Machine (SVM). De truc zorgt ervoor dat het algoritme patronen kan vinden in ingewikkelde data — zoals die cirkel-situatie — zonder dat het model alle data eerst moet omvormen naar een hogere dimensie. Dat klinkt abstract, maar de kern is dit: de Kernel Trick berekent alleen wat er gebeurt alsof de data in een andere vorm stond, zonder die vorm daadwerkelijk te maken. Dat scheelt enorm veel rekenkracht en geheugen.

Hoe werkt het eigenlijk?

Normaal gesproken zou je bij ingewikkelde patronen je data moeten omzetten naar een hogere dimensie — een extra laag toevoegen waarin die cirkel-structuur ineens wél met een rechte lijn te scheiden is. Denk aan het tillen van een plat patroon in de 3D-ruimte. Maar dat kost veel rekenkracht, en bij veel datapunten wordt het al snel onwerkbaar.

De Kernel Trick gebruikt een wiskundige functie — een zogenaamde kernel — die berekent hoe punten zich tot elkaar verhouden alsof ze in die hogere dimensie staan, zonder daadwerkelijk die omzetting te doen. De computer hoeft niet alle nieuwe coördinaten uit te rekenen, maar gebruikt een korte formule die hetzelfde resultaat geeft. Het lijkt een beetje op een sneltoets: in plaats van alle stappen te doorlopen, spring je direct naar het antwoord.

Er bestaan verschillende soorten kernels, afhankelijk van welk soort patroon je zoekt. De meest gebruikte is de RBF-kernel (Radial Basis Function), die goed werkt voor ronde, golvende patronen. Een andere is de polynomiale kernel, voor meer hoekige structuren.

Een voorbeeld uit de praktijk

Stel: je werkt bij een zorgverzekeraar en wil voorspellen welke klanten volgend jaar waarschijnlijk hogere zorgkosten hebben. Je hebt data over leeftijd, gewicht, rookgedrag, bloeddruk — maar de grens tussen 'laag risico' en 'hoog risico' loopt niet in een rechte lijn. Iemand van 30 die rookt heeft misschien meer risico dan iemand van 60 die niet rookt, en die combinaties maken het patroon complex.

Met de Kernel Trick kan een SVM die complexe grens wél vinden, zonder dat jij als data-analist zelf hoeft te bedenken hoe je leeftijd en rookgedrag moet combineren. Het model doet dat intern, dankzij de kernel.

Waar kom je het tegen?

De Kernel Trick is vooral relevant in klassieke Machine Learning, niet in moderne deep learning met neurale netwerken. Je komt het tegen in:

Support Vector Machines — het algoritme waarvoor de truc oorspronkelijk is uitgevonden

Kernel PCA — een variant van Principal Component Analysis die patronen verkent in complexe data

Wetenschappelijk onderzoek — bijvoorbeeld in biologie of financiële analyse, waar je met relatief kleine datasets werkt en geen deep learning nodig hebt

In Python-libraries zoals scikit-learn kun je bij een SVM gewoon een kernel kiezen (kernel='rbf') zonder de wiskundige details te hoeven snappen.

Waarom hoor je er steeds minder over?

Met de opkomst van neurale netwerken en deep learning is de Kernel Trick minder prominent geworden. Deep learning-modellen zoals Transformers kunnen zelf complexe patronen leren zonder dat je een kernel hoeft te kiezen. Maar voor kleinere datasets, of situaties waar je snel een model wilt trainen zonder grote rekenkracht, blijft de Kernel Trick een elegante oplossing.

Als je ooit met klassieke Machine Learning werkt — bijvoorbeeld omdat je weinig trainingsdata hebt, of omdat je begrijpelijke modellen wilt in plaats van black-box neurale netwerken — dan is de Kernel Trick een handige techniek om in je gereedschapskist te hebben. Je hoeft de wiskunde zelf niet uit te rekenen, maar het helpt om te weten dat het bestaat.

Veelgestelde vragen over Kernel Trick

De drie meest gestelde vragen over dit onderwerp, kort beantwoord.

Wat is Kernel Trick?

Een wiskundige truc die zorgt dat Machine Learning-modellen patronen kunnen herkennen in data die niet in een rechte lijn te scheiden zijn — zonder dat je de data eerst zelf hoeft om te vormen.

Waarom is Kernel Trick belangrijk?

Stel je voor: je hebt een groep rode en blauwe punten op papier, en je wilt een lijn trekken die de twee kleuren scheidt. Als alle rode punten links zitten en alle blauwe rechts, is dat makkelijk — trek gewoon een verticale streep ertussen. Maar wat als de rode punten in een cirkel zitten, met de blauwe punten eromheen? Dan kun je geen rechte lijn meer trekken die ze netjes scheidt.

Hoe wordt Kernel Trick toegepast?

De Kernel Trick is een slimme oplossing voor dit probleem. Het is een wiskundige techniek die vooral gebruikt wordt bij een klassiek Machine Learning-algoritme genaamd een Support Vector Machine (SVM). De truc zorgt ervoor dat het algoritme patronen kan vinden in ingewikkelde data — zoals die cirkel-situatie — zonder dat het model alle data eerst moet omvormen naar een hogere dimensie. Dat klinkt abstract, maar de kern is dit: de Kernel Trick berekent alleen wat er gebeurt alsof de data in een andere vorm stond, zonder die vorm daadwerkelijk te maken. Dat scheelt enorm veel rekenkracht en geheugen.