Wat is Information Bottleneck?

Een principe dat uitlegt hoe AI-modellen leren door informatie te comprimeren — alleen het belangrijkste bewaren en de rest weggooien, net zoals je een lang verhaal samenvat tot de kern.

Wat is het eigenlijk?

Stel je voor dat je een vriend het hele verhaal van een boek probeert te vertellen, maar je hebt maar vijf minuten. Je kunt niet elk detail noemen — je moet selecteren wat echt belangrijk is. Je comprimeert het verhaal tot de essentie. Precies dat proces gebeurt ook in AI-modellen tijdens het leren.

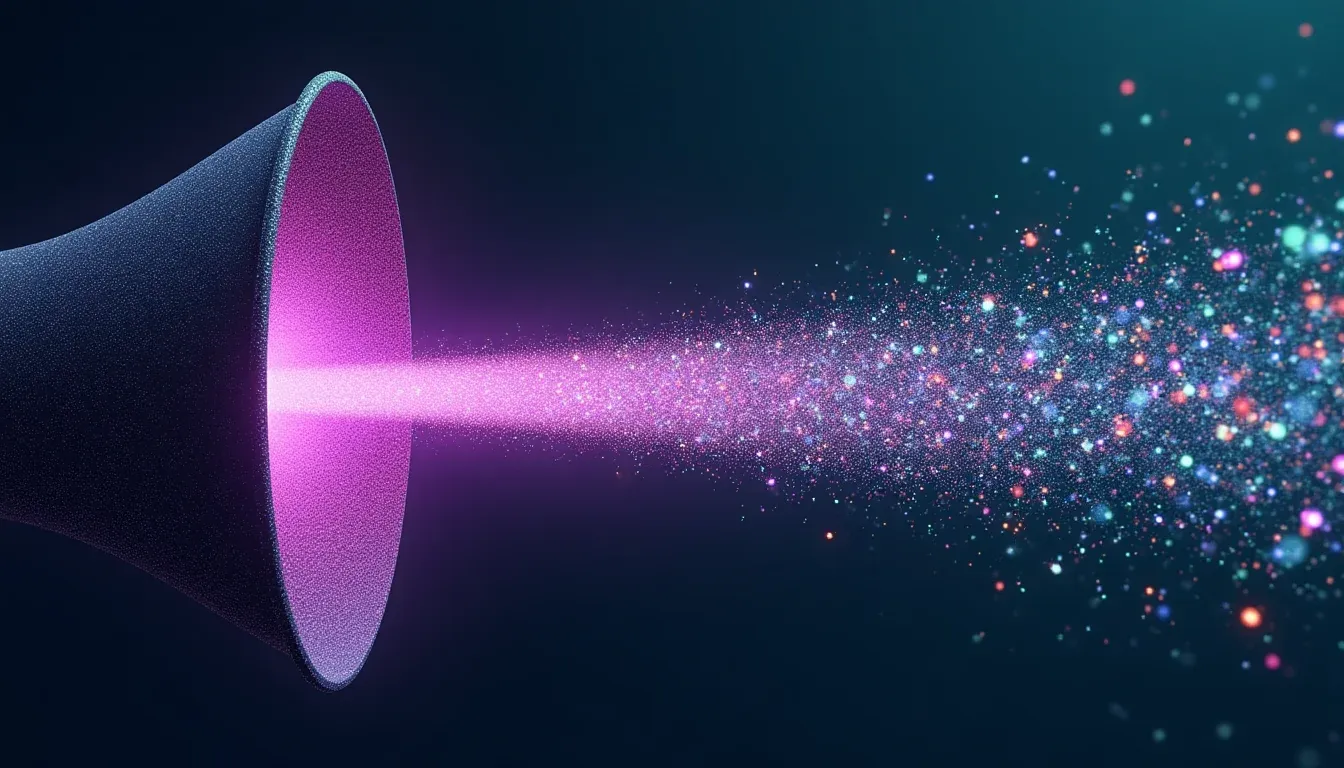

Het information bottleneck is een principe uit de informatietheorie dat beschrijft hoe neurale netwerken leren. Het idee: een model kan niet alle details van de trainingsdata onthouden (en dat wil je ook niet). In plaats daarvan dwingt de architectuur — vooral de verborgen lagen tussen input en output — het netwerk om informatie te comprimeren. Het houdt alleen wat nuttig is voor de uiteindelijke taak, en gooit ruis en irrelevante details weg.

Die compressie gebeurt letterlijk in de zogenaamde bottleneck-laag: een smalle laag met veel minder neuronen dan de input-laag. Alle informatie moet daar doorheen geperst worden, waardoor het netwerk gedwongen wordt te kiezen: wat is essentieel, wat niet?

Hoe werkt het in de praktijk?

Denk aan een autoencoder — een type netwerk dat leert data te comprimeren en weer te reconstrueren. De input is bijvoorbeeld een foto van 1000 pixels. Die gaat door een bottleneck-laag van maar 50 neuronen. In die 50 neuronen moet het model de kern van de foto vastleggen: de vormen, kleuren, hoofdlijnen. Details zoals individuele pixels of kleine ruis verdwijnen.

Hetzelfde principe zie je in andere architecturen:

Bij beeldherkenning: de eerste lagen zien alle pixels, maar diepere lagen comprimeren dat tot abstracte kenmerken zoals 'oren', 'wielen', 'letters'.

Bij taalmodellen: tekst wordt eerst omgezet in getallen, daarna gecomprimeerd tot betekenisvolle patronen, voordat het model een antwoord genereert.

Het mooie: door die compressie leert het model generaliseren. Het memoriseert niet gewoon alle trainingsvoorbeelden, maar vindt patronen die ook op nieuwe data werken.

Waarom zou jij hier iets aan hebben?

Dit concept verklaart waarom sommige AI-modellen beter werken dan andere. Een netwerk dat te weinig comprimeert (te breed, te groot) kan alle trainingsdata uit het hoofd leren — maar faalt bij nieuwe data (dat heet overfitting). Een netwerk dat te veel comprimeert (te smal) gooit juist té veel weg en leert niet genoeg.

De kunst zit in de balans: genoeg compressie om te generaliseren, maar niet zoveel dat belangrijke informatie verloren gaat. Architecten van AI-modellen gebruiken dit principe bewust — bijvoorbeeld door het aantal neuronen in een laag te beperken, of door technieken als dropout die tijdens training informatie tijdelijk 'blokkeren'.

Voor jou als gebruiker: als je begrijpt dat AI-modellen hun kennis via compressie opslaan, snap je ook beter waarom ze soms algemene patronen heel goed pakken, maar moeite hebben met hele specifieke details die je wel verwacht.

Waar kom je het tegen?

Je ziet dit principe terug in de architectuur van vrijwel alle neurale netwerken:

Autoencoders — voor beeldcompressie, anomalie-detectie, data-reductie

Variational Autoencoders (VAE) — voor het genereren van nieuwe afbeeldingen of data

Encoder-decoder modellen — bij vertaaltaken (tekst wordt eerst gecomprimeerd tot een interne representatie, dan weer uitgepakt in een andere taal)

Convolutional Neural Networks (CNN's) — de 'pooling'-lagen comprimeren beeldinformatie laag voor laag

Transformers — ook hier vindt compressie plaats via attention-mechanismen die bepalen welke delen van de input belangrijk zijn

Ook bij het ontwerp van AI-chips (zoals GPU's en TPU's) speelt het begrip bottleneck een rol: waar zit de vertraging, waar moet data doorheen?

Wat kun je ermee?

Als je zelf modellen traint of afstemt, helpt dit principe je bij het maken van architectuurkeuzes. Hoeveel lagen? Hoeveel neuronen per laag? Te weinig compressie = overfitting, te veel = underfitting. Experimenten met de breedte en diepte van je netwerk zijn eigenlijk experimenten met het information bottleneck.

En als je AI-systemen gebruikt: besef dat wat je terugkrijgt een gecomprimeerde weergave is van wat het model geleerd heeft. Het heeft details weggelaten — soms terecht (ruis), soms ten onrechte (belangrijke nuance). Dat verklaart waarom modellen soms verassend slim zijn in grote lijnen, maar struikelen over specifieke randgevallen.

Veelgestelde vragen over Information Bottleneck

De drie meest gestelde vragen over dit onderwerp, kort beantwoord.

Wat is Information Bottleneck?

Een principe dat uitlegt hoe AI-modellen leren door informatie te comprimeren — alleen het belangrijkste bewaren en de rest weggooien, net zoals je een lang verhaal samenvat tot de kern.

Waarom is Information Bottleneck belangrijk?

Stel je voor dat je een vriend het hele verhaal van een boek probeert te vertellen, maar je hebt maar vijf minuten. Je kunt niet elk detail noemen — je moet selecteren wat echt belangrijk is. Je comprimeert het verhaal tot de essentie. Precies dat proces gebeurt ook in AI-modellen tijdens het leren.

Hoe wordt Information Bottleneck toegepast?

Het information bottleneck is een principe uit de informatietheorie dat beschrijft hoe neurale netwerken leren. Het idee: een model kan niet alle details van de trainingsdata onthouden (en dat wil je ook niet). In plaats daarvan dwingt de architectuur — vooral de verborgen lagen tussen input en output — het netwerk om informatie te comprimeren. Het houdt alleen wat nuttig is voor de uiteindelijke taak, en gooit ruis en irrelevante details weg.