Wat is Global Minimum?

Het absolute laagste punt in een foutlandschap — het punt waar een AI-model de best mogelijke prestatie haalt en niet verder kan verbeteren.

Wat is een global minimum?

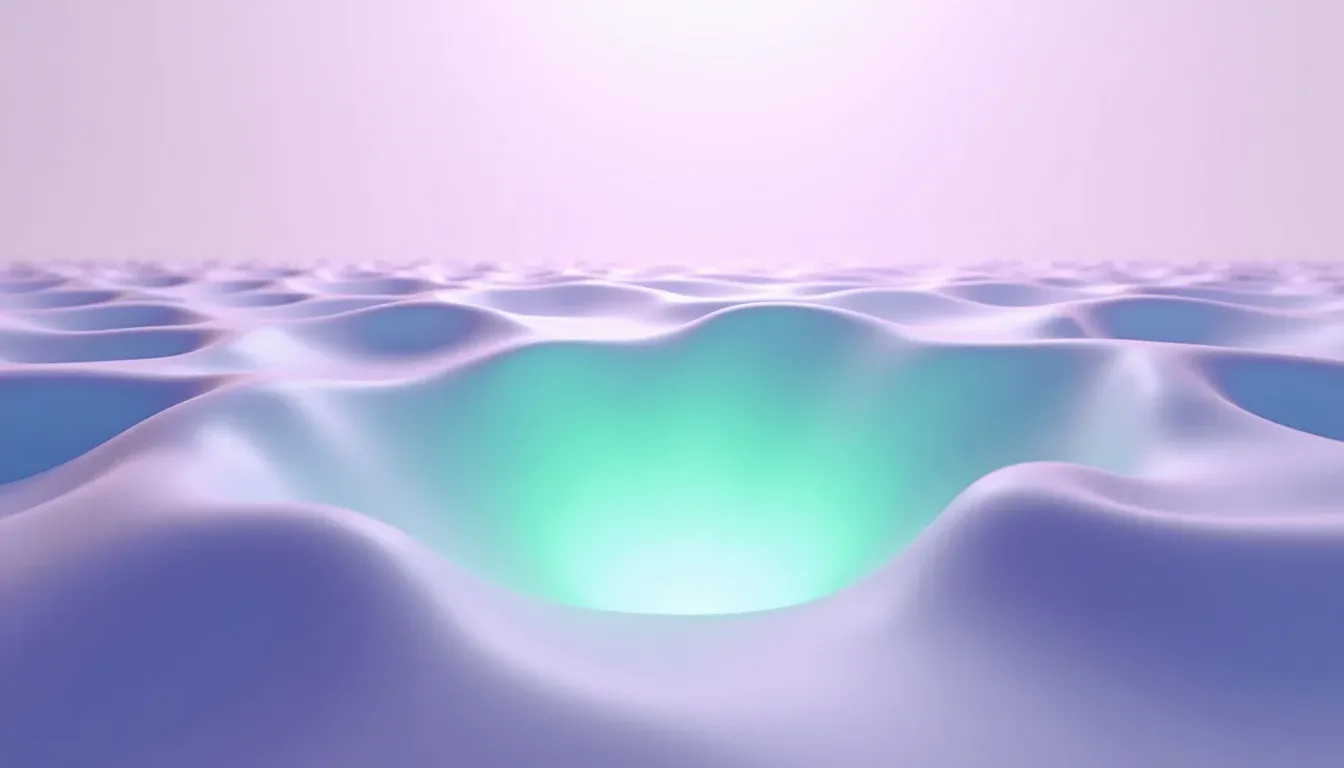

Stel je voor dat je met een blinddoek op door een heuvelachtig landschap loopt, op zoek naar het laagste punt. Je voelt met je voeten of het omlaag gaat, en je probeert steeds dieper te komen. Maar hoe weet je of je écht op het allerlaagste punt staat, of dat je gewoon in een kuiltje zit met nog diepere dalen verderop?

Dat is precies het probleem waar AI-modellen mee worstelen. Wanneer een neuraal netwerk leert, probeert het een 'foutfunctie' te minimaliseren — een soort score die aangeeft hoe slecht het model presteert. Die foutfunctie kun je zien als een landschap vol heuvels en dalen. Het global minimum is het allerdiepste dal in dat hele landschap: het punt waar de fout het kleinst is en het model dus het beste werkt.

Het lastige is dat dit landschap bij deep learning-modellen ontzettend complex is — met miljoenen of zelfs miljarden dimensies. Het model ziet tijdens training alleen de lokale omgeving en weet niet of het in een klein kuiltje zit (een 'local minimum') of echt op het diepste punt.

Waarom is dit zo lastig te vinden?

In de praktijk is het vinden van het global minimum bijna onmogelijk — en dat hoeft ook niet altijd. Hier zijn de belangrijkste redenen:

Gigantisch zoekgebied: Bij een model met 100 miljoen parameters is het foutlandschap 100 miljoen-dimensionaal. Dat kun je niet uitputtend doorzoeken.

Local minima: Er zijn vaak duizenden 'goede genoeg'-punten waar het model vastloopt, zonder te weten of er ergens een nog beter punt bestaat.

Saddle points: Veel punten die eruitzien als een minimum zijn eigenlijk zadelpunten — plat in sommige richtingen, maar nog steeds dalend in andere.

Moderne optimalisatie-algoritmes zoals Adam of SGD (Stochastic Gradient Descent) proberen het model zo efficiënt mogelijk door dit landschap te leiden, maar ze garanderen niet dat je het global minimum vindt. Gelukkig blijkt in de praktijk dat veel 'goede' local minima ook prima werken voor de taak.

Een voorbeeld uit de praktijk

Stel je traint een beeldherkenningsmodel om foto's van katten en honden te onderscheiden. Het model begint met willekeurige waarden en maakt heel veel fouten — het zit hoog in het foutlandschap. Tijdens training daalt het steeds verder: eerst herkent het simpele patronen (oren, snuit), later subtielere kenmerken.

Op een gegeven moment stabiliseert de fout zich rond de 5%. Dat kan een local minimum zijn: prima bruikbaar, maar misschien bestaat er ergens in dat enorme landschap nog een configuratie die 3% fout haalt — het global minimum. In de praktijk weet je dat nooit zeker, en vaak is het verschil zo klein dat het niet uitmaakt.

Waar kom je het tegen?

De term 'global minimum' hoor je vooral in technische discussies over:

Trainingsprocessen: Bij het tunen van hyperparameters probeer je het model dichter bij een global minimum te krijgen

Optimalisatie-algoritmes: Sommige nieuwe methodes zoals evolutionary strategies of simulated annealing beloven beter te kunnen ontsnappen aan local minima

Wetenschappelijk onderzoek: Papers over neural network optimisation analyseren of bepaalde architecturen of technieken sneller naar goede minima convergeren

Praktische tools: Frameworks als PyTorch en TensorFlow implementeren verschillende optimizers die elk hun eigen strategie hebben om diepe dalen te vinden

Is het vinden ervan essentieel?

Interessant genoeg: nee. Veel succesvolle AI-modellen in productie zitten waarschijnlijk in een 'goed genoeg' local minimum, niet in het theoretische global minimum. Het verschil in prestatie is vaak verwaarloosbaar, terwijl het zoeken naar dat absolute dieptepunt oneindig lang zou kunnen duren.

De kunst van modern deep learning is dus niet zozeer het vinden van het global minimum, maar het efficiënt bereiken van een punt waar het model goed genoeg werkt voor jouw specifieke toepassing. Denk aan het verschil tussen een foutpercentage van 2,1% en 2,0% — theoretisch interessant, maar praktisch vaak niet de enorme extra rekentijd waard.

Als je zelf een model traint en merkt dat de prestatie niet meer verbetert, zit je waarschijnlijk vast in een minimum. Of dat het global minimum is? Dat weet je eigenlijk nooit zeker — maar als het model goed genoeg werkt, maakt het ook niet zo veel uit.

Veelgestelde vragen over Global Minimum

De drie meest gestelde vragen over dit onderwerp, kort beantwoord.

Wat is Global Minimum?

Het absolute laagste punt in een foutlandschap — het punt waar een AI-model de best mogelijke prestatie haalt en niet verder kan verbeteren.

Waarom is Global Minimum belangrijk?

Stel je voor dat je met een blinddoek op door een heuvelachtig landschap loopt, op zoek naar het laagste punt. Je voelt met je voeten of het omlaag gaat, en je probeert steeds dieper te komen. Maar hoe weet je of je écht op het allerlaagste punt staat, of dat je gewoon in een kuiltje zit met nog diepere dalen verderop?

Hoe wordt Global Minimum toegepast?

Dat is precies het probleem waar AI-modellen mee worstelen. Wanneer een neuraal netwerk leert, probeert het een 'foutfunctie' te minimaliseren — een soort score die aangeeft hoe slecht het model presteert. Die foutfunctie kun je zien als een landschap vol heuvels en dalen. Het global minimum is het allerdiepste dal in dat hele landschap: het punt waar de fout het kleinst is en het model dus het beste werkt.