Wat is Gated Recurrent Unit?

Een slim type geheugencel in AI die leert wat belangrijk is om te onthouden en wat vergeten mag worden — ideaal voor tekst, spraak en tijdreeksen.

Wat is een Gated Recurrent Unit eigenlijk?

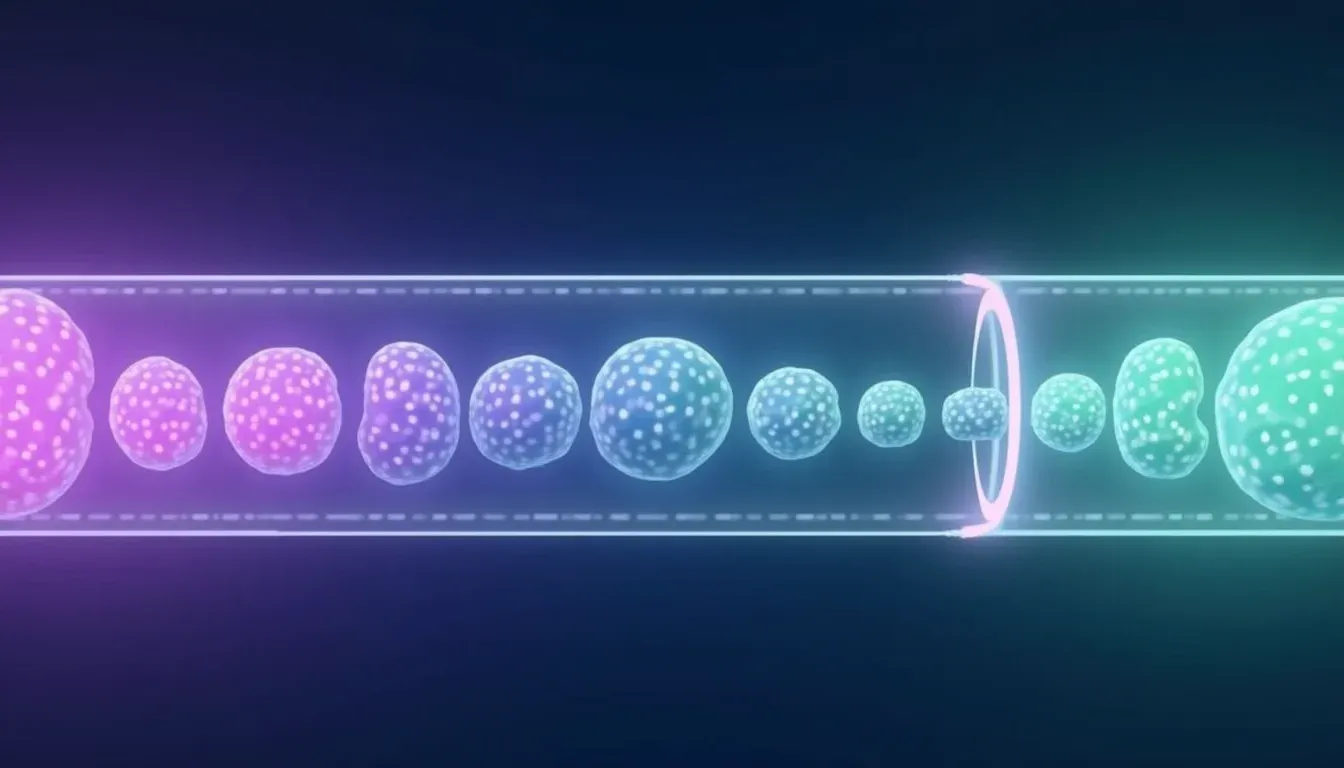

Stel je voor: je leest een lange zin. Halverwege moet je nog weten waar de zin over begon, maar niet elk tussenwoord hoef je vast te houden. Een Gated Recurrent Unit (GRU) werkt zo: het is een soort slim geheugen in een neuraal netwerk dat zelf leert wat belangrijk is om te onthouden en wat het beter kan vergeten.

Een GRU is een bouwsteen in AI-systemen die werken met sequenties — dingen die in een bepaalde volgorde komen, zoals woorden in een zin, noten in een muziekstuk of dagelijkse verkoopcijfers. Het netwerk leert tijdens training welke informatie uit het verleden nuttig is voor de volgende stap, en welke informatie alleen maar ruis is.

Hoe werkt zo'n geheugencel?

Een GRU heeft twee 'poortjes' die beslissen wat er met informatie gebeurt:

Update gate — beslist hoeveel nieuwe informatie er binnenkomt. Stel: je leest "Het was zonnig, maar later..." — het netwerk leert dat "later" belangrijk is en dat het weer kan veranderen.

Reset gate — beslist hoeveel oude informatie vergeten mag worden. Als een nieuwe zin begint, kan het netwerk besluiten de vorige zin grotendeels los te laten.

Deze poortjes zijn geen bewuste keuzes, maar wiskundige mechanismes die tijdens training worden afgesteld. Ze zorgen ervoor dat het netwerk niet vastloopt in irrelevante details, maar ook niet vergeet wat ertoe doet.

Waarom zou jij hier iets aan hebben?

Voor 2014 hadden AI-systemen grote moeite met lange sequenties. Ze 'vergaten' wat er aan het begin van een zin stond als die zin te lang werd. De GRU (ontwikkeld door onderzoekers Cho et al. in 2014) lost dat op met een elegante balans tussen onthouden en vergeten.

GRU's zijn vooral populair omdat ze:

Efficiënter zijn dan hun voorganger (de LSTM-cel) — minder parameters, sneller te trainen

Goed presteren bij middelgrote datasets en niet-extreme sequenties

Praktisch inzetbaar zijn op apparaten met beperkte rekenkracht

Tegenwoordig zijn GRU's grotendeels vervangen door Transformer-architecturen voor hele lange teksten, maar ze zijn nog steeds waardevol voor real-time toepassingen, edge computing en situaties waar snelheid en efficiëntie belangrijker zijn dan maximale nauwkeurigheid.

Een voorbeeld uit de praktijk

Stel: een webshop wil voorspellen hoeveel van een product er volgende week verkocht wordt. De verkoopcijfers variëren per dag, seizoen, promoties. Een GRU-netwerk leert patronen herkennen: het 'onthoudt' dat er elke vrijdag een piek is, dat er rond Black Friday een enorme stijging komt, en dat kleine dagelijkse schommelingen minder belangrijk zijn.

Of neem spraakherkenning: als je "Hallo, hoe gaat het met jou?" zegt, moet het systeem onthouden dat de zin een vraag is, maar niet elk geluidsgolfje individueel vasthouden. De GRU filtert wat relevant is.

Waar kom je het tegen?

GRU's zitten in tal van AI-systemen die met sequenties werken:

Chatbots en taalmodellen (vooral oudere of lichtere modellen voor mobiel)

Spraakherkenningssystemen en voice assistants

Muziekgeneratie en audioverwerking

Tijdreeksvoorspellingen (aandelen, verkoop, energieverbruik)

Machine translation (vertaalsystemen van voor de Transformer-revolutie)

In moderne frameworks zoals TensorFlow en PyTorch zit een GRU-laag standaard ingebouwd, klaar voor gebruik.

Wat kun je er nu mee?

Als je zelf met sequentiedata werkt — denk aan klantgedrag over tijd, sensordata, financiële data — dan is een GRU een toegankelijke en snelle manier om patronen te vinden zonder je te verliezen in complexiteit. Het is geen alleskunner meer zoals een paar jaar geleden, maar voor veel praktische toepassingen nog steeds een betrouwbare, efficiënte keuze. Wil je experimenteren? Begin met een simpele voorspellingstask in Python met Keras — een GRU-laag toevoegen is letterlijk één regel code.

Veelgestelde vragen over Gated Recurrent Unit

De drie meest gestelde vragen over dit onderwerp, kort beantwoord.

Wat is Gated Recurrent Unit?

Een slim type geheugencel in AI die leert wat belangrijk is om te onthouden en wat vergeten mag worden — ideaal voor tekst, spraak en tijdreeksen.

Waarom is Gated Recurrent Unit belangrijk?

Stel je voor: je leest een lange zin. Halverwege moet je nog weten waar de zin over begon, maar niet elk tussenwoord hoef je vast te houden. Een Gated Recurrent Unit (GRU) werkt zo: het is een soort slim geheugen in een neuraal netwerk dat zelf leert wat belangrijk is om te onthouden en wat het beter kan vergeten.

Hoe wordt Gated Recurrent Unit toegepast?

Een GRU is een bouwsteen in AI-systemen die werken met sequenties — dingen die in een bepaalde volgorde komen, zoals woorden in een zin, noten in een muziekstuk of dagelijkse verkoopcijfers. Het netwerk leert tijdens training welke informatie uit het verleden nuttig is voor de volgende stap, en welke informatie alleen maar ruis is.