Wat is Fairness Metric?

Een meetinstrument om te checken of een AI-systeem verschillende groepen mensen gelijk behandelt, zodat je discriminatie of ongelijkheid kunt opsporen.

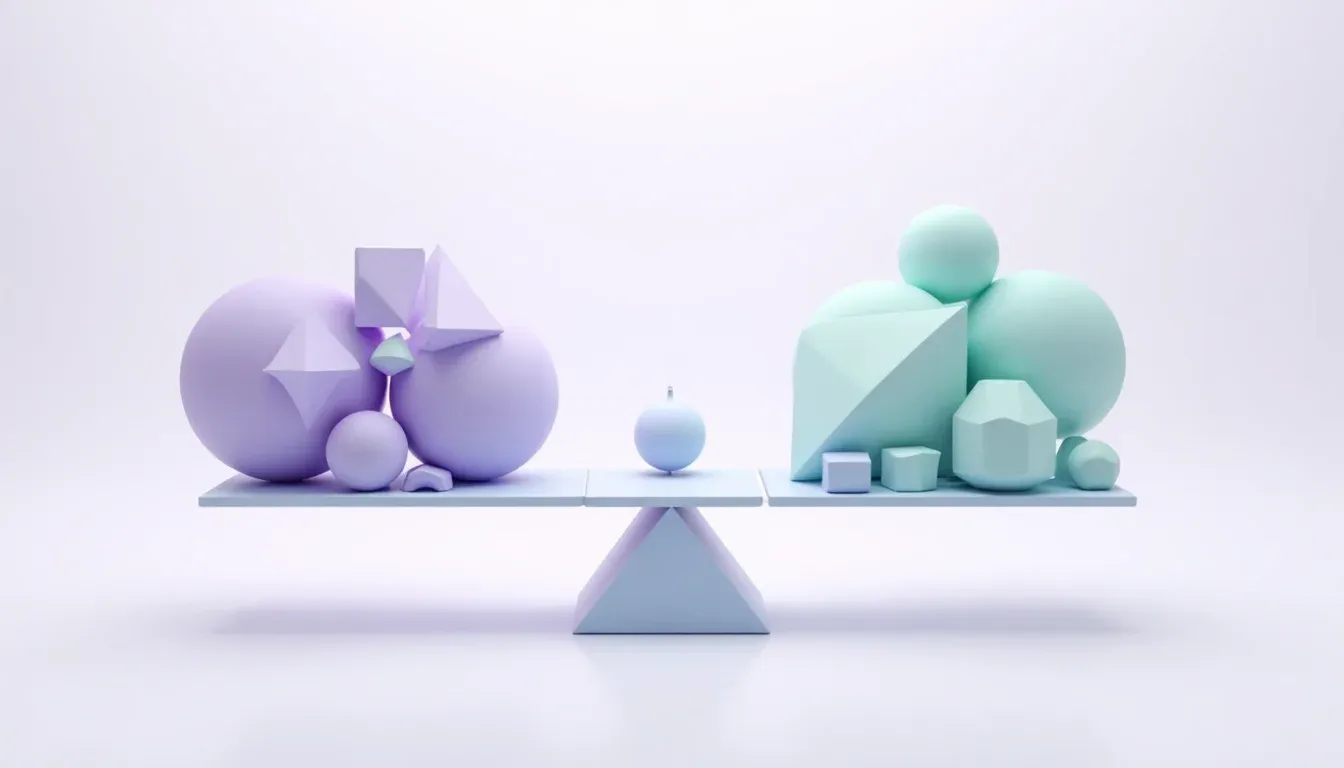

Waarom meten we 'eerlijkheid' bij AI?

Als een algoritme bepaalt wie een lening krijgt, wie uitgenodigd wordt voor een sollicitatiegesprek of wie welke zorg krijgt, wil je dat het niet systematisch bepaalde groepen bevoordeelt of benadeelt. Maar hoe weet je of een systeem 'eerlijk' is? Daar zijn fairness metrics voor: meetinstrumenten die in data zichtbaar maken of een AI voor verschillende groepen tot vergelijkbare uitkomsten komt.

Stel je voor: een recruitmenttool selecteert kandidaten. Als je ziet dat 80% van de mannen wordt doorgelaten maar slechts 40% van de vrouwen (terwijl beide groepen even sterk zijn), dan wijst die metric je op een mogelijk probleem.

Verschillende definities van eerlijkheid

Het lastige: 'eerlijk' kan op meerdere manieren worden gedefinieerd, en die definities botsen soms. Hier zijn de meest gebruikte:

Demographic Parity: elke groep krijgt even vaak een positieve uitkomst (bv. even vaak een lening toegekend). Deze metric kijkt naar het eindresultaat, ongeacht de achterliggende kenmerken.

Equal Opportunity: als iemand in aanmerking komt voor iets (bv. daadwerkelijk kredietwaardig is), moet elk groep dezelfde kans hebben om geselecteerd te worden. Dit kijkt naar de 'true positive rate'.

Predictive Parity: als het systeem voorspelt dat iemand geschikt is, moet die voorspelling even betrouwbaar zijn voor alle groepen. Anders gezegd: een 'ja' moet voor iedereen evenveel waard zijn.

Calibration: als het systeem zegt "80% kans op succes", moet dat voor elke groep ook daadwerkelijk 80% succes betekenen.

Wat eerlijk is hangt af van je context en waarden. Een bank kan kiezen voor predictive parity (betrouwbare voorspellingen), terwijl een overheidsinstantie juist demographic parity belangrijk vindt (gelijke toegang).

Hoe werkt zo'n metric in de praktijk?

Je neemt de output van je AI-model en splitst die op per groep (geslacht, leeftijd, etniciteit, postcode — afhankelijk van wat relevant is). Vervolgens bereken je voor elke groep een statistiek: hoeveel procent positieve beslissingen, hoeveel false positives, hoeveel false negatives. Door die cijfers naast elkaar te leggen, zie je of er grote verschillen zijn.

Bijvoorbeeld: een creditscoring-model geeft aan 70% van groep A een hoge score, maar aan slechts 50% van groep B — terwijl beide groepen historisch gezien even vaak hun lening terugbetalen. Dan signaleert de metric een ongelijkheid die je verder moet onderzoeken.

Een voorbeeld uit het bedrijfsleven

Een verzekeringsmaatschappij gebruikt AI om te bepalen welke klanten een aanvullende verzekering aangeboden krijgen. Na implementatie blijkt uit fairness-metingen dat mensen in bepaalde wijken significant minder vaak geselecteerd worden, ook als hun risicoprofiel vergelijkbaar is. De metriek maakt dit zichtbaar, waarna de verzekeraar besluit het model bij te stellen of extra checks in te bouwen.

Waar kom je het tegen?

Recruitment-tools (zoals HireVue, Pymetrics): ingebouwde dashboards die laten zien of kandidaten uit verschillende groepen even vaak geselecteerd worden

Kredietscoring-systemen (bij banken en fintechs): vaak wettelijk verplicht om discriminatie tegen te gaan

Overheids-AI: gemeenten en uitvoeringsorganisaties die algoritmes gebruiken voor toeslagen, vergunningen of fraude-detectie checken vaak fairness-metrics

Open-source tools zoals Fairlearn (Microsoft), AI Fairness 360 (IBM), What-If Tool (Google): bibliotheken waarmee developers zelf metrics kunnen berekenen

Audits door toezichthouders: zoals de Autoriteit Persoonsgegevens of gemeentelijke algoritmeregisters

Beperkingen en nuance

Geen enkele metric geeft het complete verhaal. Je kunt wiskundig 'eerlijk' scoren op één metric en toch oneerlijke uitkomsten produceren volgens een andere definitie. Bovendien: metrics meten alleen wat je meet — als je bepaalde groepen niet eens in je data hebt, blijven problemen onzichtbaar.

Daarom worden fairness metrics altijd gecombineerd met menselijke beoordeling, contextkennis en soms juridisch advies. Ze zijn een hulpmiddel, geen orakel.

Wat kun je er nu mee?

Als je een AI-systeem bouwt of inkoopt dat over mensen besluit, vraag dan: welke fairness-metrics worden gebruikt? En belangrijker: waarom juist díe? Door die vraag te stellen dwing je transparantie af en voorkom je dat 'eerlijkheid' een holle belofte blijft. Voor veel sectoren (financieel, HR, overheid) is het meten van fairness inmiddels geen nice-to-have meer, maar een vereiste — zowel ethisch als juridisch.

Veelgestelde vragen over Fairness Metric

De drie meest gestelde vragen over dit onderwerp, kort beantwoord.

Wat is Fairness Metric?

Een meetinstrument om te checken of een AI-systeem verschillende groepen mensen gelijk behandelt, zodat je discriminatie of ongelijkheid kunt opsporen.

Waarom is Fairness Metric belangrijk?

Als een algoritme bepaalt wie een lening krijgt, wie uitgenodigd wordt voor een sollicitatiegesprek of wie welke zorg krijgt, wil je dat het niet systematisch bepaalde groepen bevoordeelt of benadeelt. Maar hoe weet je of een systeem 'eerlijk' is? Daar zijn fairness metrics voor: meetinstrumenten die in data zichtbaar maken of een AI voor verschillende groepen tot vergelijkbare uitkomsten komt.

Hoe wordt Fairness Metric toegepast?

Stel je voor: een recruitmenttool selecteert kandidaten. Als je ziet dat 80% van de mannen wordt doorgelaten maar slechts 40% van de vrouwen (terwijl beide groepen even sterk zijn), dan wijst die metric je op een mogelijk probleem.