Wat is Distribution Shift?

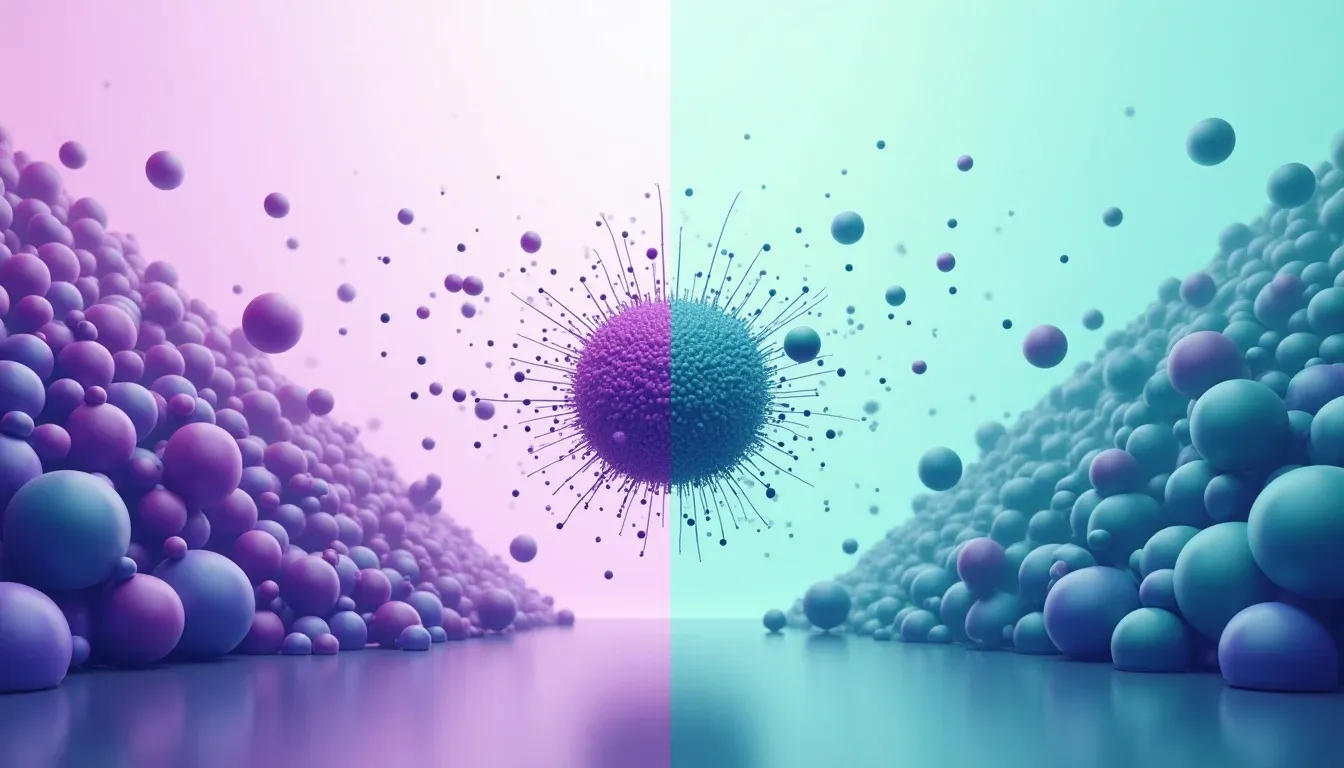

Wanneer de data waar een AI-model mee getraind is, anders is dan de data die het in de praktijk tegenkomt — waardoor voorspellingen minder betrouwbaar worden.

Wat is dit eigenlijk?

Stel je voor: je leert autorijden in een rustige woonwijk met brede straten en weinig verkeer. Je haalt je rijbewijs, voelt je zelfverzekerd — en dan zet iemand je plotseling in de spits op de ring van Amsterdam. Alle regels zijn nog hetzelfde, maar de situatie is zó anders dat je opeens veel meer moeite hebt.

Dat is in een notendop wat Distribution Shift betekent voor AI-modellen. Een model leert patronen uit trainingsdata — bijvoorbeeld duizenden foto's van honden en katten, gescand in goede belichting. Maar zodra je datzelfde model foto's van slecht verlichte straatkatten laat analyseren, of katten in de sneeuw, kan de nauwkeurigheid ineens zakken. Niet omdat het model "dom" is geworden, maar omdat de wereld er nu anders uitziet dan tijdens de training.

In technische termen: de verdeling (distribution) van de data is verschoven. De patronen, de verhoudingen, de contexten — ze wijken af van wat het model gewend is.

Waarom gebeurt dit?

Er zijn een paar veelvoorkomende redenen:

Tijd: de wereld verandert. Een model getraind op nieuwsartikelen uit 2019 heeft geen idee wat "corona" of "lockdown" betekent in 2020.

Locatie: een spraakherkenningsmodel getraind op Amerikaans Engels herkent Schots accent vaak veel slechter.

Populatie: een medisch model getraind op data van ziekenhuispatiënten werkt minder goed op gezonde mensen thuis.

Techniek: als je trainingsdata bestaat uit professionele foto's, maar gebruikers uploaden smartphone-kiekjes met filters, is dat een shift.

Het lastige: tijdens de training zie je dit probleem niet. Alles lijkt te werken. Pas in de echte wereld — bij wat we "deployment" noemen — blijkt dat de prestaties tegenvallen.

Een voorbeeld uit de praktijk

Een webshop bouwt een aanbevelingssysteem op basis van aankoopgedrag uit 2022 en 2023. Het model leert: "mensen die sportschoenen kopen, kopen vaak ook sportkleding." Werkt prima.

Dan breekt er in 2024 een hardloophype uit door een populaire Netflix-serie. Opeens kopen mensen massaal hardloopschoenen, maar geen kleding — ze hebben die al. Het model blijft sportkleding aanbevelen, maar de conversie zakt in elkaar. De data-verdeling is verschoven: andere motivaties, ander gedrag.

Of neem een fraudedetectiemodel bij een bank. Getraind op fraude-patronen van 2020. Maar cybercriminelen passen hun technieken aan. In 2024 gebruiken ze nieuwe methoden die het model nooit heeft gezien. Het herkent de oude trucs nog steeds, maar de nieuwe glippen erdoorheen.

Waar kom je het tegen?

Distribution Shift is eigenlijk overal waar AI-modellen in de echte wereld worden ingezet:

Zelfrijdende auto's: getraind in Californië, maar ingezet in Nederland met fietspaden, rotonden en sneeuw

Creditscoring: modellen die verouderd raken door economische crisissen of nieuwe betaalvormen

Medische AI: getraind op CT-scans van één ziekenhuis, gebruikt in een ander met andere scanners

Chatbots: getraind op klantvragen van vorig jaar, maar dit jaar stellen klanten andere vragen door nieuwe producten

Spam-filters: spammers passen hun tactieken voortdurend aan

Bij tools zoals ChatGPT, Claude of Gemini is dit minder zichtbaar omdat ze regelmatig opnieuw getraind worden. Maar voor bedrijven die hun eigen modellen bouwen en draaien, is dit een doorlopend aandachtspunt.

Hoe ga je ermee om?

De gouden regel: blijf monitoren. Meet niet alleen tijdens de training hoe goed je model werkt, maar ook maandelijks (of wekelijks) in productie. Zakt de nauwkeurigheid? Dan is er mogelijk een shift.

Andere strategieën:

Regelmatig opnieuw trainen met recente data

Diverse trainingsdata verzamelen: meer variatie = robuuster model

Domein-adaptatie: technieken om een model aan te passen aan nieuwe situaties zonder helemaal opnieuw te beginnen

Feedback-loops: laat het model leren van fouten in productie

En soms: bewust kiezen voor simpelere, meer stabiele modellen in plaats van het allernieuwste — omdat je weet dat de wereld zal veranderen.

Wat kun je er nu mee?

Als je een AI-project overweegt of al draait: vraag je af of de trainingsdata representatief is voor de situatie waarin het model straks gebruikt wordt. Niet alleen nú, maar ook over een half jaar. En bouw monitoring in — zodat je shifts opmerkt voordat je klanten of gebruikers het merken. Distribution Shift is geen bug, maar een eigenschap van de echte, veranderende wereld. Anticiperen erop maakt het verschil tussen een model dat blijft werken en een model dat langzaam irrelevant wordt.

Veelgestelde vragen over Distribution Shift

De drie meest gestelde vragen over dit onderwerp, kort beantwoord.

Wat is Distribution Shift?

Wanneer de data waar een AI-model mee getraind is, anders is dan de data die het in de praktijk tegenkomt — waardoor voorspellingen minder betrouwbaar worden.

Waarom is Distribution Shift belangrijk?

Stel je voor: je leert autorijden in een rustige woonwijk met brede straten en weinig verkeer. Je haalt je rijbewijs, voelt je zelfverzekerd — en dan zet iemand je plotseling in de spits op de ring van Amsterdam. Alle regels zijn nog hetzelfde, maar de situatie is zó anders dat je opeens veel meer moeite hebt.

Hoe wordt Distribution Shift toegepast?

Dat is in een notendop wat Distribution Shift betekent voor AI-modellen. Een model leert patronen uit trainingsdata — bijvoorbeeld duizenden foto's van honden en katten, gescand in goede belichting. Maar zodra je datzelfde model foto's van slecht verlichte straatkatten laat analyseren, of katten in de sneeuw, kan de nauwkeurigheid ineens zakken. Niet omdat het model "dom" is geworden, maar omdat de wereld er nu anders uitziet dan tijdens de training.