Wat is Depthwise Convolution?

Een slimme truc in beeldherkenning waarbij een AI-model per kleurlaag apart naar patronen kijkt in plaats van alles tegelijk — veel sneller en lichter dan traditionele methodes.

Wat is het eigenlijk?

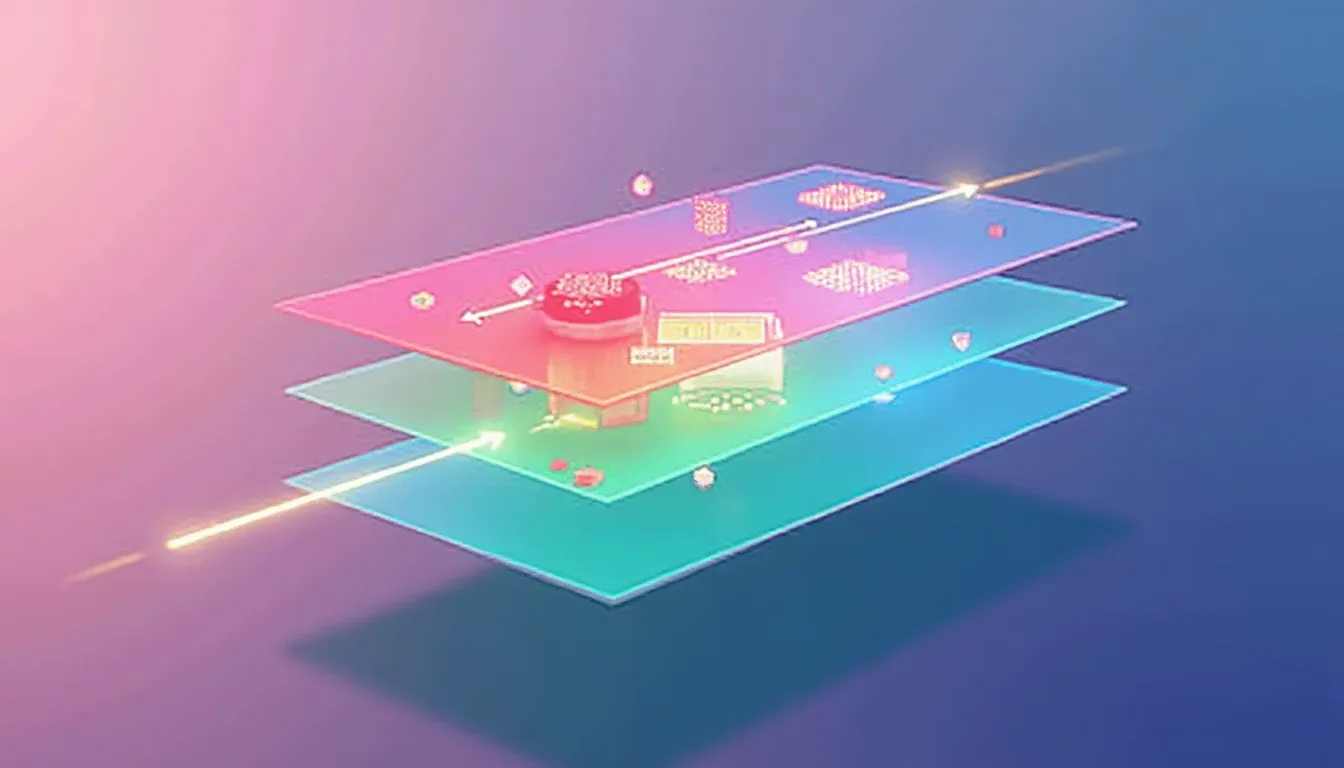

Stel je voor dat je een foto door een vergrootglas bekijkt. Je zou kunnen kiezen om de hele foto in één keer te analyseren, of je kunt slim zijn en eerst apart naar de rode tinten kijken, dan de groene, dan de blauwe. Pas daarna combineer je je bevindingen. Dat tweede is in essentie wat een depthwise convolution doet.

In gewone beeldherkenning kijkt een AI-model naar alle kleurlagen (rood, groen, blauw) tegelijk wanneer het patronen zoekt — bijvoorbeeld de rand van een object of de textuur van een oppervlak. Dat werkt prima, maar kost enorm veel rekenkracht. Een depthwise convolution splitst dit proces: het model kijkt eerst per kleurlaag afzonderlijk naar patronen, en combineert die resultaten pas daarna. Het is alsof je eerst drie puzzels apart legt voordat je ze samenvoegt, in plaats van alle stukjes door elkaar te gooien.

Het resultaat? Hetzelfde inzicht, maar met veel minder berekeningen. Denk aan 8 tot 9 keer minder werk voor de computer. Dat scheelt enorm in energie, snelheid en benodigde hardware.

Waarom zou jij hier iets aan hebben?

Deze techniek is geen obscure wiskundige gimmick — het is een van de redenen dat je smartphone foto's kan herkennen zonder dat je batterij leeg is na tien minuten. Door depthwise convolutions kunnen AI-modellen voor beeldherkenning veel compacter worden gemaakt, waardoor ze op apparaten met beperkte rekenkracht kunnen draaien.

Denk aan:

Gezichtsherkenning op je telefoon die offline werkt

Objectdetectie in beveiligingscamera's die direct ter plekke beslissingen nemen

Augmented reality-apps die real-time moeten reageren zonder vertraging

Medische scan-analyse waar snelheid levens kan redden

Voor bedrijven betekent dit dat je AI-toepassingen kunt bouwen die goedkoper zijn om te draaien (minder cloud-kosten) en sneller werken (betere gebruikerservaring). Voor ontwikkelaars betekent het dat complexe modellen opeens bereikbaar worden op hardware die je al hebt.

Hoe werkt het onder de motorkap?

Een traditionele convolutie werkt als een filter dat over een afbeelding schuift. Bij elke stap kijkt het filter naar een klein vierkantje van pixels — bijvoorbeeld 3×3 — en berekent het voor alle kleurlagen tegelijk een nieuw getal. Als je afbeelding 64 kleurlagen heeft (wat in diepe netwerken normaal is), dan moet het model 64 lagen tegelijk verwerken. Dat stapelt op.

Een depthwise convolution doet dit anders:

Stap 1 — Depthwise: Het model past per kleurlaag een apart filter toe. Elke laag krijgt zijn eigen 3×3 filter dat alleen naar die specifieke laag kijkt.

Stap 2 — Pointwise: Daarna combineert het model de resultaten met een simpele 1×1 operatie die de lagen weer samenvoegt.

Door deze splitsing doe je veel minder vermenigvuldigingen. Het is vergelijkbaar met het verschil tussen alle ingrediënten tegelijk in een pan gooien versus ze eerst apart voorbereiden en dan samenbrengen — beide leveren een maaltijd, maar de tweede methode geeft je meer controle en efficiëntie.

Waar kom je het tegen?

Depthwise convolutions zitten verwerkt in moderne, lichte AI-architecturen die specifiek ontworpen zijn voor mobiele apparaten en edge computing:

MobileNet — een populaire modelarchitectuur voor smartphones

EfficientNet — modellen die prestatie en snelheid balanceren

Xception — een architectuur die depthwise convolutions centraal stelt

TensorFlow Lite en PyTorch Mobile — frameworks die deze technieken gebruiken voor on-device AI

Je merkt het niet direct, maar wanneer je een app gebruikt die gezichten herkent, QR-codes scant of objecten in je camera-beeld benoemt zonder internetverbinding, is de kans groot dat er ergens een depthwise convolution aan het werk is.

Wat kun je ermee?

Als je een ontwikkelaar bent die aan beeldherkenning werkt, loont het om je te verdiepen in architecturen die depthwise convolutions gebruiken. Je kunt modellen bouwen die 5-10 keer sneller zijn zonder veel nauwkeurigheid te verliezen. Dat opent deuren naar toepassingen die anders onhaalbaar zouden zijn — denk aan real-time video-analyse op goedkope hardware of AI-assistenten die volledig lokaal op een apparaat draaien.

Ook als je geen technicus bent: begrip van dit soort technieken helpt je beter inschatten wat wel en niet haalbaar is in AI-projecten, en waarom sommige oplossingen ineens betaalbaar worden terwijl ze dat een paar jaar geleden nog niet waren.

Veelgestelde vragen over Depthwise Convolution

De drie meest gestelde vragen over dit onderwerp, kort beantwoord.

Wat is Depthwise Convolution?

Een slimme truc in beeldherkenning waarbij een AI-model per kleurlaag apart naar patronen kijkt in plaats van alles tegelijk — veel sneller en lichter dan traditionele methodes.

Waarom is Depthwise Convolution belangrijk?

Stel je voor dat je een foto door een vergrootglas bekijkt. Je zou kunnen kiezen om de hele foto in één keer te analyseren, of je kunt slim zijn en eerst apart naar de rode tinten kijken, dan de groene, dan de blauwe. Pas daarna combineer je je bevindingen. Dat tweede is in essentie wat een depthwise convolution doet.

Hoe wordt Depthwise Convolution toegepast?

In gewone beeldherkenning kijkt een AI-model naar alle kleurlagen (rood, groen, blauw) tegelijk wanneer het patronen zoekt — bijvoorbeeld de rand van een object of de textuur van een oppervlak. Dat werkt prima, maar kost enorm veel rekenkracht. Een depthwise convolution splitst dit proces: het model kijkt eerst per kleurlaag afzonderlijk naar patronen, en combineert die resultaten pas daarna. Het is alsof je eerst drie puzzels apart legt voordat je ze samenvoegt, in plaats van alle stukjes door elkaar te gooien.