Wat is Confusion Matrix?

Een overzichtelijke tabel die laat zien hoe vaak een AI-model het goed of fout voorspelt — handig om te zien waar het model precies de mist in gaat.

Wat is een Confusion Matrix?

Stel je voor dat je een AI-model hebt gemaakt dat moet bepalen of een e-mail spam is of niet. Na een tijd wil je natuurlijk weten: hoe vaak zit het model er nou eigenlijk naast? En belangrijker nog: welke fouten maakt het precies?

Dat is precies waarvoor een Confusion Matrix bedoeld is. Het is een overzichtelijke tabel die laat zien hoe vaak je model dingen goed voorspelt, en welke soorten fouten het maakt. In het geval van die spam-detector:

Hoeveel spam-mails herkent het correct als spam? (true positive)

Hoeveel normale mails labelt het ten onrechte als spam? (false positive)

Hoeveel spam-mails laat het per ongeluk door? (false negative)

Hoeveel normale mails herkent het correct als normaal? (true negative)

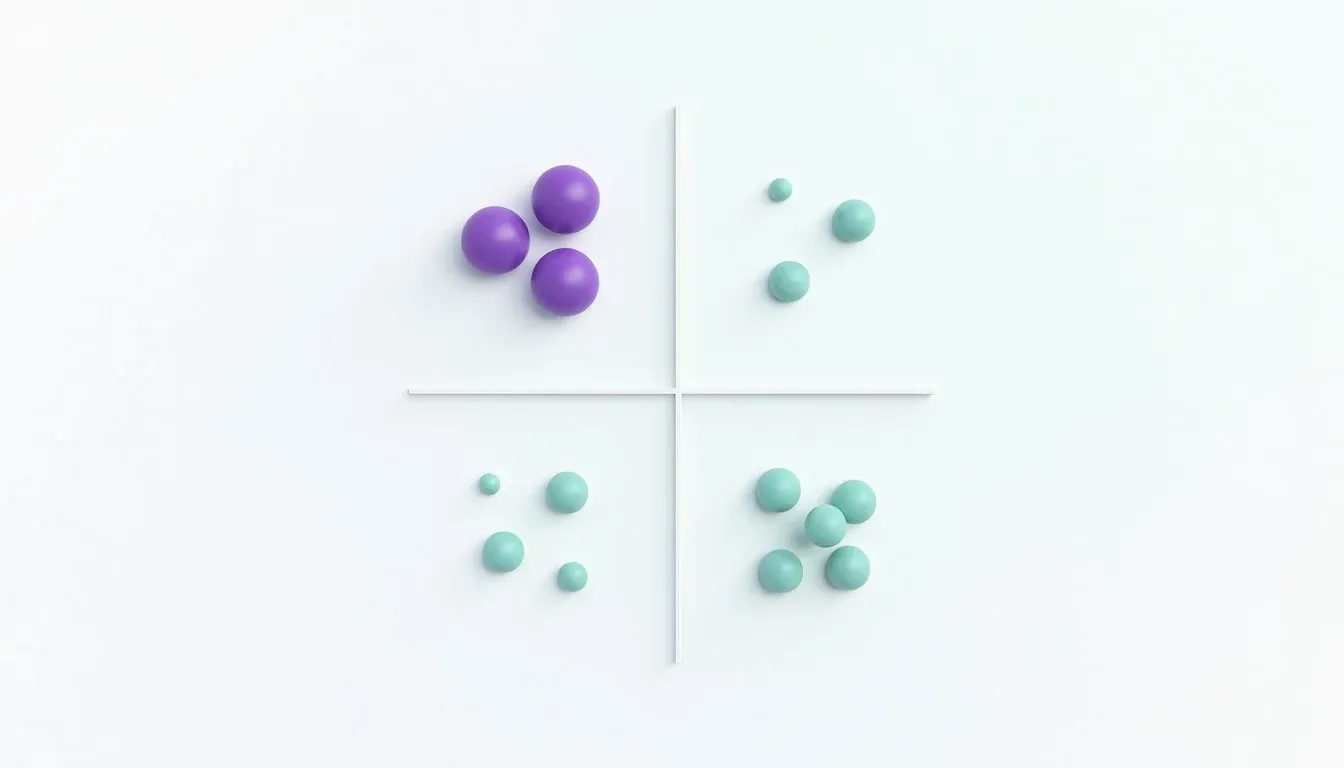

Die vier getallen zet je in een tabel van 2×2, en dat is je Confusion Matrix. De naam klinkt ingewikkelder dan het is — het gaat letterlijk om waar je model 'in de war' (confused) raakt.

Waarom is dit belangrijk?

Een simpel accuracy-percentage vertelt je niet het hele verhaal. Stel dat 95% van alle mails normaal is en 5% spam. Als je model lui is en alles als 'normaal' classificeert, haalt het 95% accuracy — maar het vangt geen enkele spam!

Met een Confusion Matrix zie je meteen wat er echt aan de hand is. Je ziet bijvoorbeeld:

False positives (vals alarm) — het model denkt dat iets fout is terwijl het goed is. Bij medische diagnoses kan dit leiden tot onnodige behandelingen.

False negatives (gemiste gevallen) — het model mist iets belangrijks. Bij kankertests kan dit levensgevaarlijk zijn.

Afhankelijk van je toepassing wil je de ene fout meer vermijden dan de andere. Een spamfilter mag best wat false positives hebben (een enkele goede mail in je spammap), maar een model dat fraude detecteert moet vooral false negatives vermijden (gemiste fraude kost geld).

Een voorbeeld uit de praktijk

Stel je voor: je bouwt een model dat hondenfoto's herkent. Je test het op 100 foto's:

60 echte hondenfoto's → model herkent er 55 correct, mist er 5

40 foto's zonder hond → model classificeert er 35 correct, maar denkt bij 5 foto's ten onrechte dat er een hond op staat

Je Confusion Matrix ziet er dan zo uit:

`` Voorspeld: Hond Voorspeld: Geen hond Echt: Hond 55 5 Echt: Geen hond 5 35 ``

Uit deze tabel kun je allerlei nuttige metrics afleiden, zoals precision (hoe vaak klopt het als het model 'hond' zegt?) en recall (hoeveel van alle honden vindt het model?).

Waar kom je het tegen?

Praktisch elke AI-tool voor machine learning heeft ingebouwde functies om een Confusion Matrix te maken:

Scikit-learn (Python) —

confusion_matrix()functieTensorFlow/Keras — evaluatie-tools na training

Azure Machine Learning — automatische evaluatie-dashboards

Google Cloud AI Platform — model-evaluatie interface

Amazon SageMaker — ingebouwde metrics en visualisaties

Als je een classificatiemodel bouwt (spam/niet-spam, hond/kat, goedaardig/kwaadaardig), is een Confusion Matrix eigenlijk altijd onderdeel van de evaluatie.

Wat kun je ermee?

Als je zelf een AI-model aan het trainen bent of resultaten moet beoordelen, is de Confusion Matrix je beste vriend. Het helpt je om:

Zwakke plekken te spotten — welke categorieën verwart het model met elkaar?

Trade-offs te maken — wil je liever te voorzichtig zijn (meer false positives) of juist strenger (meer false negatives)?

Je model te verbeteren — als je ziet waar het misgaat, kun je gerichter meer trainingsdata verzamelen voor die specifieke gevallen

Zelfs als je geen data scientist bent: als iemand je een AI-model presenteert met alleen een accuracy-percentage, vraag dan naar de Confusion Matrix. Die vertelt het echte verhaal.

Veelgestelde vragen over Confusion Matrix

De drie meest gestelde vragen over dit onderwerp, kort beantwoord.

Wat is Confusion Matrix?

Een overzichtelijke tabel die laat zien hoe vaak een AI-model het goed of fout voorspelt — handig om te zien waar het model precies de mist in gaat.

Waarom is Confusion Matrix belangrijk?

Stel je voor dat je een AI-model hebt gemaakt dat moet bepalen of een e-mail spam is of niet. Na een tijd wil je natuurlijk weten: hoe vaak zit het model er nou eigenlijk naast? En belangrijker nog: welke fouten maakt het precies?

Hoe wordt Confusion Matrix toegepast?

Dat is precies waarvoor een Confusion Matrix bedoeld is. Het is een overzichtelijke tabel die laat zien hoe vaak je model dingen goed voorspelt, en welke soorten fouten het maakt. In het geval van die spam-detector: