Wat is Autoencoder-Based Reduction?

Een methode om complexe data te vereenvoudigen door een AI-model te trainen dat eerst informatie comprimeert en daarna weer probeert te reconstrueren — waarbij alleen de essentie overblijft.

Wat is dit eigenlijk?

Stel je voor dat je een enorme stapel foto's hebt, en je wilt ze opslaan zonder gigabytes ruimte te verbruiken. Je zou kunnen bedenken: "Wat als ik elke foto samenvat tot zijn kern-ingrediënten, en later die samenvatting weer gebruik om de foto terug te bouwen?"

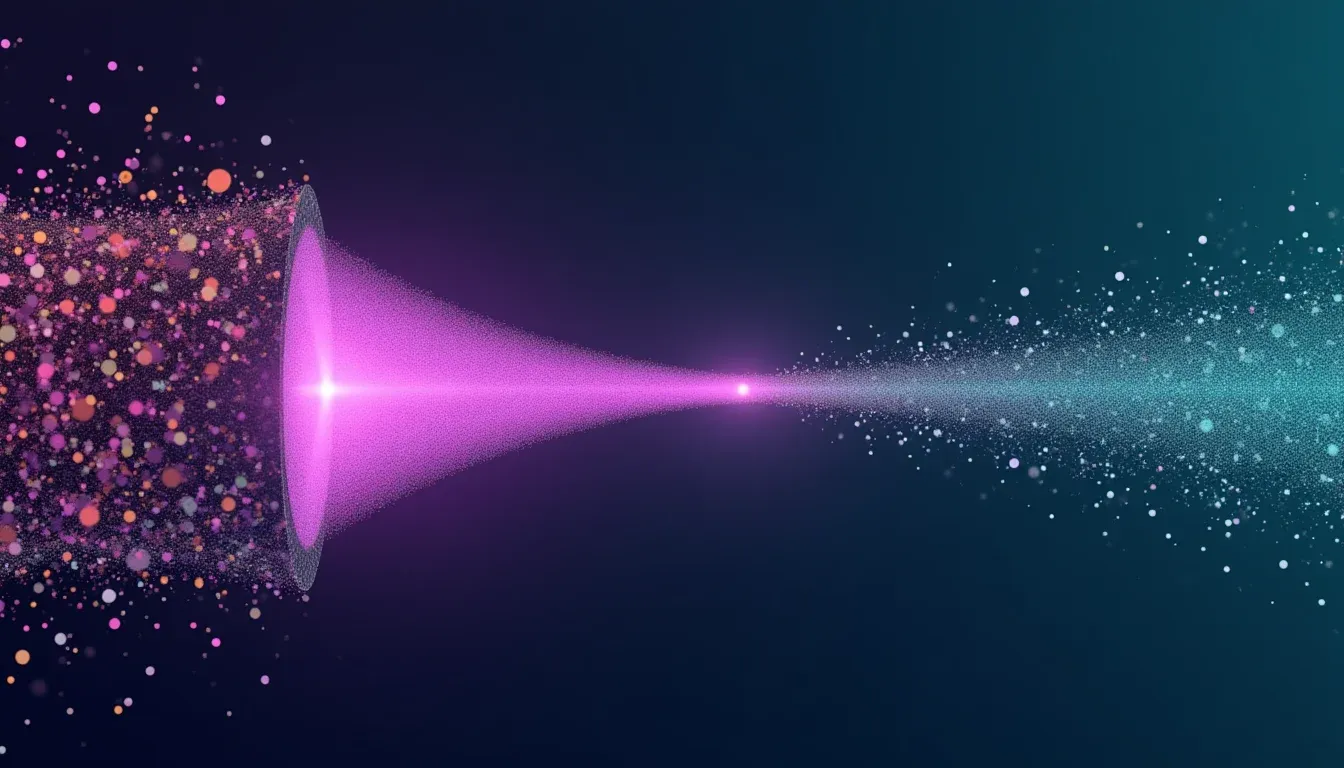

Dat is precies wat een autoencoder doet. Het is een soort AI-model dat twee taken combineert: eerst perst het data in een veel kleinere vorm (de "reductie"), en daarna probeert het uit die kleine vorm de originele data weer na te maken. Door dit proces leert het model vanzelf wát belangrijk is — en wat je kunt weglaten.

Het mooie: die geperste vorm, die tussentrap, bevat alleen nog de essentie. Dat maakt autoencoders perfect voor het vereenvoudigen van complexe datasets, zoals afbeeldingen, geluiden of tabellen vol getallen.

Hoe werkt het eigenlijk?

Een autoencoder bestaat uit twee delen:

Encoder: Dit deel neemt je originele data (bijvoorbeeld een kleurenfoto van 1000×1000 pixels) en comprimeert die naar een veel kleinere representatie — vaak slechts een rijtje van pakweg 50 getallen. Die getallen noemen we de "latente representatie" of "embedding".

Decoder: Dit deel probeert uit die 50 getallen de originele foto weer terug te bouwen.

Tijdens de training vergelijk je de gereconstrueerde foto met het origineel. Hoe meer ze op elkaar lijken, hoe beter je model de belangrijkste kenmerken heeft geleerd. Het verlies aan detail — de ruis, pixels die toch niet zo belangrijk zijn — verdwijnt vanzelf.

Wat overblijft is die latente representatie: een sterk vereenvoudigde versie van je data, waarin alleen de essentie zit. En díe kun je vervolgens gebruiken voor visualisaties, clustering, anomalie-detectie of andere analyses.

Waarom zou jij hier iets aan hebben?

Autoencoder-based reduction is vooral handig als je met grote, complexe datasets werkt waar je patronen in wilt ontdekken:

Beeldanalyse: Je hebt duizenden productfoto's en wilt ze groeperen op stijl of kleur, zonder handmatig labels te plakken.

Fraudedetectie: Banktransacties comprimeren tot hun kern, zodat afwijkende patronen direct opvallen.

Geluidsverwerking: Audiofragmenten samenvatten tot hun belangrijkste kenmerken, zodat je bijvoorbeeld muziekstijlen automatisch kunt herkennen.

Dataverzending: Sensordata van IoT-apparaten eerst comprimeren voordat je ze verstuurt, om bandbreedte te besparen.

Het grote voordeel boven oudere methoden zoals PCA (Principal Component Analysis) is dat autoencoders niet-lineaire patronen kunnen vangen — ze zijn dus slimmer in het herkennen van ingewikkelde structuren.

Een voorbeeld uit de praktijk

Stel: je bent kwaliteitsmanager in een fabriek en je meet elke seconde 200 sensorwaarden (temperatuur, trilling, druk, etc.). Die enorme hoeveelheid data is lastig te overzien.

Je traint een autoencoder die al die 200 waardes comprimeert naar 3 getallen. Op een grafiek met 3 assen zie je nu opeens heldere clusters: normale productie zit netjes bij elkaar, maar één machine vertoont een afwijkend patroon. Dat was in de ruwe data onzichtbaar, maar in de gecomprimeerde vorm spring het eruit.

Dat is de kracht: door data te reduceren tot de essentie, zie je wat er echt toe doet.

Waar kom je het tegen?

Autoencoder-based reduction wordt breed toegepast, maar je ziet het niet altijd als eindgebruiker. Achter de schermen wordt het gebruikt in:

Aanbevelingssystemen (Netflix, Spotify) om gebruikersgedrag te comprimeren tot voorkeursprofielen

Medische beeldanalyse om MRI-scans te vereenvoudigen voor snellere diagnose

Cybersecurity om netwerkverkeer te monitoren op afwijkingen

Creatieve AI-tools zoals afbeeldingsgeneratoren (DALL-E, Stable Diffusion gebruiken varianten op autoencoders)

In Python-bibliotheken zoals TensorFlow, PyTorch en Keras kun je zelf autoencoders bouwen. Ook tools als scikit-learn bieden gerelateerde reductiemethoden, al zijn autoencoders daar niet standaard ingebouwd.

Wat kun je er nu mee?

Als je grote datasets hebt en je wilt begrijpen wat erin zit — maar je verdrinkt in de complexiteit — dan is autoencoder-based reduction een krachtig gereedschap. Het helpt je om van een overweldigende hoeveelheid informatie naar heldere, bruikbare inzichten te gaan.

Je hoeft geen data scientist te zijn om het principe te snappen: het gaat erom dat een slim model voor jou uitzoekt wat belangrijk is. En die essentie, die gecomprimeerde kern, is vaak precies wat je nodig hebt om betere beslissingen te nemen.

Veelgestelde vragen over Autoencoder-Based Reduction

De drie meest gestelde vragen over dit onderwerp, kort beantwoord.

Wat is Autoencoder-Based Reduction?

Een methode om complexe data te vereenvoudigen door een AI-model te trainen dat eerst informatie comprimeert en daarna weer probeert te reconstrueren — waarbij alleen de essentie overblijft.

Waarom is Autoencoder-Based Reduction belangrijk?

Stel je voor dat je een enorme stapel foto's hebt, en je wilt ze opslaan zonder gigabytes ruimte te verbruiken. Je zou kunnen bedenken: "Wat als ik elke foto samenvat tot zijn kern-ingrediënten, en later die samenvatting weer gebruik om de foto terug te bouwen?"

Hoe wordt Autoencoder-Based Reduction toegepast?

Dat is precies wat een autoencoder doet. Het is een soort AI-model dat twee taken combineert: eerst perst het data in een veel kleinere vorm (de "reductie"), en daarna probeert het uit die kleine vorm de originele data weer na te maken. Door dit proces leert het model vanzelf wát belangrijk is — en wat je kunt weglaten.